Merge branch 'master' into master

@@ -12,13 +12,13 @@

|

||||

|

||||

我分为两大块:先想清楚你干了什么,在训练好你表达的规范性

|

||||

|

||||

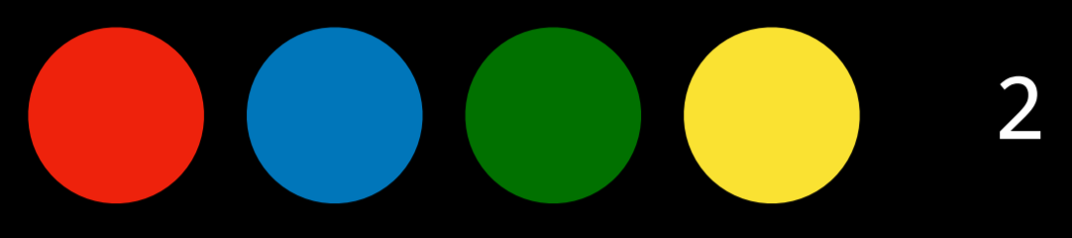

<font color=green>大白话 -》提取后的逻辑链条</font> -》<font color=red>科研写作 -》英文翻译</font>

|

||||

<font color=green>大白话 -> 提取后的逻辑链条</font> -> <font color=red>科研写作 -> 英文翻译</font>

|

||||

|

||||

<strong>干了什么:</strong>

|

||||

**干了什么:**

|

||||

|

||||

1. 如果没有想清楚要做的是什么,要写什么,可以先用大白话,在草稿上写,有利于理清思路,抽丝剥茧

|

||||

|

||||

失败案例:一上来直接英文【】‘’写作,一会 we want ,一会 80 个词语的长难句,思路英语都不清晰

|

||||

失败案例:一上来直接英文[ ] ' '写作,一会 we want,一会 80 个词语的长难句,思路英语都不清晰

|

||||

|

||||

2. 先列出 Outline 每一个科研 section 你打算做什么,尝试去回答问题

|

||||

|

||||

@@ -33,9 +33,11 @@

|

||||

|

||||

1: How do we verify that we solved it:

|

||||

|

||||

1a) Experimental results1b)

|

||||

1a) Experimental results

|

||||

|

||||

TheoryExtra space? Future work!Extra points for havingFigure 1

|

||||

1b) Theory Extra space? Future work!

|

||||

|

||||

Extra points for having Figure 1

|

||||

|

||||

on the first page

|

||||

|

||||

@@ -43,7 +45,7 @@

|

||||

|

||||

之所以要用大白话是因为基础的不足,如果有一定功底的人,可能先天写出来文字自带规范性,所以仅供大家参考)

|

||||

|

||||

<strong>表达规范性:</strong>

|

||||

**表达规范性:**

|

||||

|

||||

此处的方法论为一句话,则是从模仿到超越的浑然天成。

|

||||

|

||||

@@ -51,7 +53,6 @@

|

||||

|

||||

2. 迭代式写作,尝试多次更改写作的内容,优秀的作品都是改出来的,在把一部分的意思表达清晰知识

|

||||

|

||||

|

||||

上述内容是写作的怎么去写,而下面则是内容层面,什么样的文章算是一篇好的文章

|

||||

|

||||

::: warning 📌

|

||||

@@ -59,6 +60,6 @@ C 会文章与 A 会文章的区别认知:

|

||||

|

||||

(1).C 是对于相关工作一个是罗列,A 是整理相关工作的脉络和方法类别,以及方法缺陷。

|

||||

|

||||

(2).对于设计的方法,C会只是说明我们比另外几个模型好,并不能从原理层面深入分析为什么比别人好,而A会则是能够说明每一部设计对模型的增量效果,以及为什么要做这一步。

|

||||

(2).对于设计的方法,C 会只是说明我们比另外几个模型好,并不能从原理层面深入分析为什么比别人好,而 A 会则是能够说明每一部设计对模型的增量效果,以及为什么要做这一步。

|

||||

|

||||

:::

|

||||

:::

|

||||

|

||||

@@ -2,20 +2,20 @@

|

||||

|

||||

author:廖总

|

||||

|

||||

<em>Last revised 2023/04/18</em>

|

||||

*Last revised 2023/04/18*

|

||||

|

||||

先声夺人:AI 时代最大的陷阱,就是盲目考察 AI 能为我们做什么,而不去考虑我们能为 AI 提供什么

|

||||

|

||||

### <em>免责声明</em>

|

||||

## *免责声明*

|

||||

|

||||

本文纯文本量达 16k(我也不知道字数统计的 28k 是怎么来的),在这 游离散乱的主线 和 支离破碎的文字 中挣扎,可能浪费您生命中宝贵的十数分钟。

|

||||

|

||||

但如果您坚持尝试阅读,可能看到如下内容(假设没在其中绕晕的话 ):

|

||||

但如果您坚持尝试阅读,可能看到如下内容(假设没在其中绕晕的话):

|

||||

|

||||

- 对大语言模型本质 以及 AI 时代人们生产创作本位 的讨论

|

||||

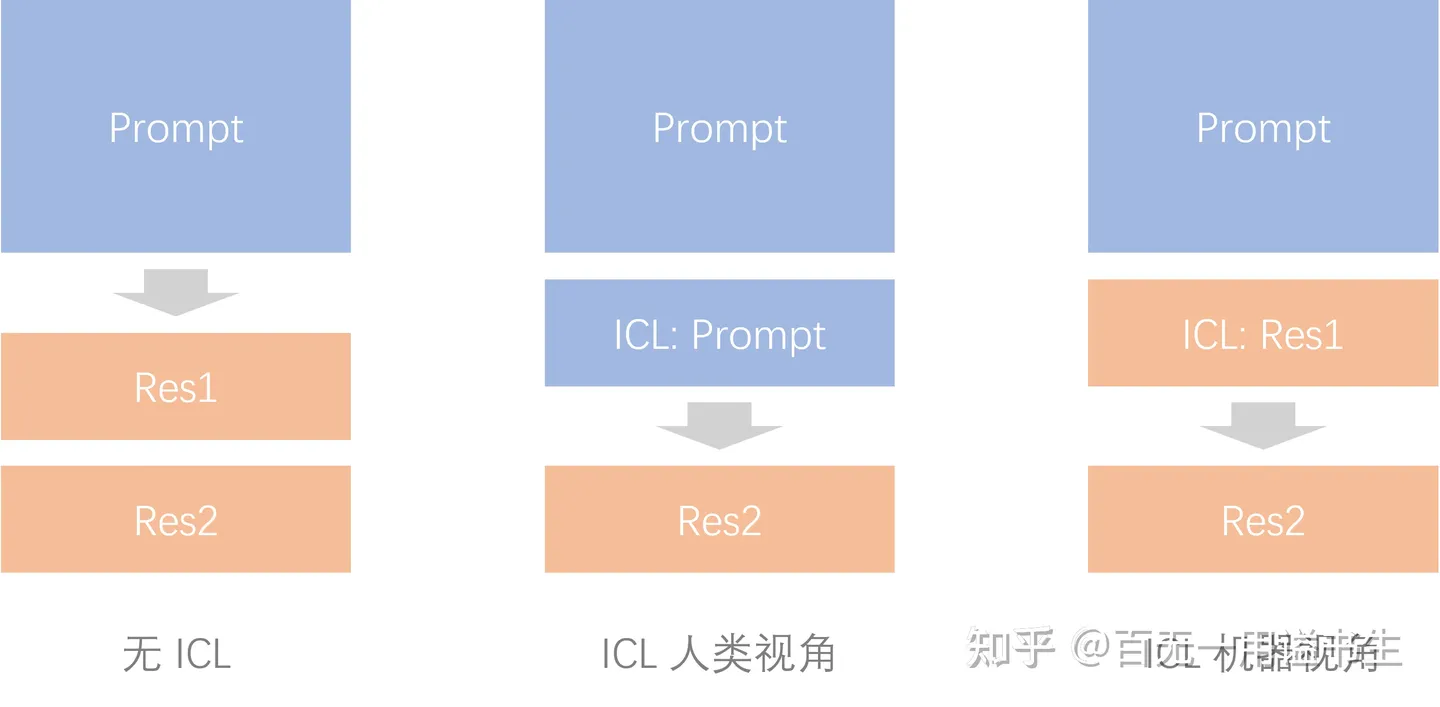

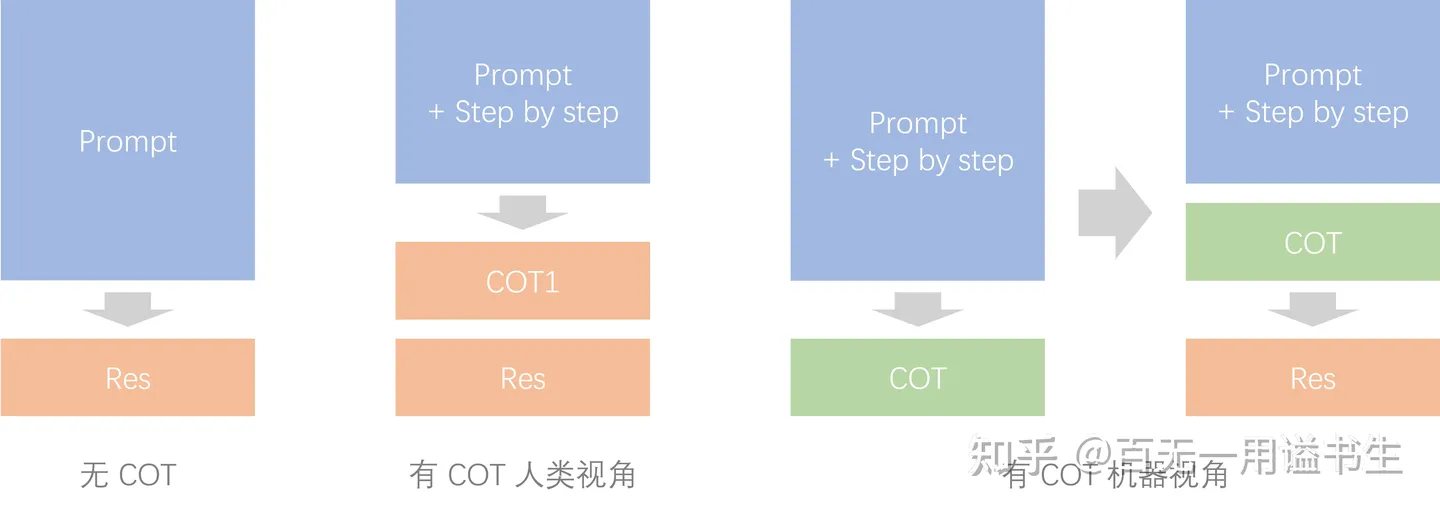

- 对大语言模型 上下文学习(In-Context Learning,ICL)和 思维链(Chain of Thought,COT)能力的几种通识性认知

|

||||

- 围绕 Prompt Decomposition 对使用大语言模型构建复杂应用的基础讨论

|

||||

- 对当前热门大模型 Agent 化框架(如 Generative Agents (即斯坦福 25 人小镇)、AutoGPT)其本质的讨论

|

||||

- 对当前热门大模型 Agent 化框架(如 Generative Agents(即斯坦福 25 人小镇)、AutoGPT)其本质的讨论

|

||||

- 对使用大语言模型构建智能系统(基于全局工作空间意识理论)的初步讨论

|

||||

- 对使用大语言模型构建符合当今生产需求的智能系统的方法论讨论

|

||||

|

||||

@@ -31,7 +31,7 @@ author:廖总

|

||||

- LLMs 能力考察:讨论了大语言模型涌现的一系列基本能力,并讨论基于这些基本能力和工程化,大模型能做到哪一步

|

||||

- Decomp 方法论:将大语言模型微分化使用的方法论,以此展开对大语言模型的新认知

|

||||

- AI 作为智能系统:结合 Generative Agents、AutoGPT 两项工作讨论大语言模型本身的局限性,围绕人类认知模型的启发,讨论通过构建复杂系统使得 LLMs Agent 化的可能性

|

||||

- 予智能以信息:讨论基于 LLMs 构建能够充分帮助我们提升生产力的 AI 剩余的一切痛点。借以回到主题 —— 在 AI 时代,我们要打造什么样的生产和信息管理新范式 (有一说,还是空口无凭)

|

||||

- 予智能以信息:讨论基于 LLMs 构建能够充分帮助我们提升生产力的 AI 剩余的一切痛点。借以回到主题 —— 在 AI 时代,我们要打造什么样的生产和信息管理新范式(有一说,还是空口无凭)

|

||||

|

||||

总体而言,本文包括对 LLM 领域近一个月的最新几项工作(TaskMatrix、HuggingGPT、Generative Agents、AutoGPT)的讨论,并基于此考察一个真正可用的 AI 会以什么样的形态出现在我们面前。

|

||||

|

||||

@@ -43,7 +43,7 @@ author:廖总

|

||||

|

||||

仅作展望。

|

||||

|

||||

# 引言

|

||||

## 引言

|

||||

|

||||

在开启正式讨论之前,我们希望从两个角度分别对 AI 进行讨论,从而夹逼出我们 从 AI 到 智能系统 的主题

|

||||

|

||||

@@ -56,7 +56,7 @@ author:廖总

|

||||

|

||||

以前只知前边两句,现在才知精髓全在后者

|

||||

|

||||

## 形而下者器:LLMs + DB 的使用样例

|

||||

### 形而下者器:LLMs + DB 的使用样例

|

||||

|

||||

(为了不让话题一开场就显得那么无聊,我们先来谈点有意思的例子)

|

||||

|

||||

@@ -77,7 +77,7 @@ author:廖总

|

||||

|

||||

(后面会给出更多关联的讨论,这里就先不赘叙了)

|

||||

|

||||

## 形而上者道:对 LLM 既有智能能力及其局限性的讨论

|

||||

### 形而上者道:对 LLM 既有智能能力及其局限性的讨论

|

||||

|

||||

这一节中,想讨论一下人工智能与人类智能的碰撞()

|

||||

|

||||

@@ -99,7 +99,7 @@ ChatGPT Plugins 在两篇论文两个角度的基础上,对 LLMs 的能力的

|

||||

- 为 AI 提供接口,为 AI 拓展能力

|

||||

- 建模自身问题,促进有效生成

|

||||

|

||||

### 从人工智能到人类智能

|

||||

#### 从人工智能到人类智能

|

||||

|

||||

在上面的论断中,我们看似已经能将绝大多数智能能力出让予 AI 了,但我还想从另一角度对 AI 与人类的能力进行展开讨论:

|

||||

|

||||

@@ -109,7 +109,7 @@ ChatGPT Plugins 在两篇论文两个角度的基础上,对 LLMs 的能力的

|

||||

- “人工”智能:辅佐 AI 实现的智能

|

||||

- 人类智能:于人类独一无二的东西

|

||||

|

||||

### AI 智能的形态

|

||||

#### AI 智能的形态

|

||||

|

||||

大语言模型的原始目的是制造一个“压缩器”,设计者们希望他能有效地学习世界上所有信息,并对其进行通用的压缩。

|

||||

|

||||

@@ -120,11 +120,11 @@ ChatGPT Plugins 在两篇论文两个角度的基础上,对 LLMs 的能力的

|

||||

> “人总是要死的,苏格拉底也是人,所以苏格拉底是要死的”<br/>这是一个经典苏格拉底式的三段论,其中蕴含着人类对于演绎推理能力的智慧。<br/>假设上面的样本是 LLM 既有学习的,而这时来了一个新的样本:<br/>“人不吃饭会被饿死,我是人,所以我也是要恰饭的嘛”<br/>那么对于一个理想的智能压缩器而言,其可能发现新句与旧句之间的关联,并有效学习到了句子的表征形式及其背后的逻辑

|

||||

|

||||

$$

|

||||

S1=<(人,苏格拉底,死),三段式推理>

|

||||

S1=<(人,苏格拉底,死),三段式推理>

|

||||

$$

|

||||

|

||||

$$

|

||||

S2=<(人,我,恰饭),三段式推理>

|

||||

S2=<(人,我,恰饭),三段式推理>

|

||||

$$

|

||||

|

||||

> 而随后,压缩器会倾向于储存三段式推理这一智能结构,并在一定程度上丢弃后来的(人,我,恰饭)这一实体关系组,仅简单建模其间联系,并在生成时按需调整预测权重。

|

||||

@@ -144,7 +144,7 @@ LLM 的实质上还是通过“语言结构”对“外显人类智能”进行

|

||||

|

||||

而也正是这些固有缺陷,为人类的自我定位和进一步利用 AI 找到了立足点。

|

||||

|

||||

### 赋能 AI 实现智能

|

||||

#### 赋能 AI 实现智能

|

||||

|

||||

作为上面一点的衍生,我们可以从大体两个角度去辅助 AI 智能的实现:

|

||||

|

||||

@@ -200,13 +200,13 @@ LLM 的实质上还是通过“语言结构”对“外显人类智能”进行

|

||||

|

||||

简而言之,我希望能追随着 AI 的发展,讨论是否能构建这样一个通用的 AI 框架,并将其引入工作生产的方方面面。希望能讨论及如何对生产信息进行有效的管理,也包括如何让我们更好调用 AI,如何让 AI 满足我们的生产需要。

|

||||

|

||||

# LLMs:生成原理及能力考察

|

||||

## LLMs:生成原理及能力考察

|

||||

|

||||

相信无论是否专业,各位对 LLMs 的生成原理都有着一定的认知

|

||||

|

||||

简单来说,这就是一个单字接龙游戏,通过自回归地预测“下一个字”。在这个过程的训练中,LLMs 学习到了知识结构,乃至一系列更复杂的底层关联,成为了一种人类无法理解的智能体。

|

||||

|

||||

## In-Context Learning / Chain of Thought

|

||||

### In-Context Learning / Chain of Thought

|

||||

|

||||

经过人们对模型背后能力的不懈考察,发现了一系列亮点,其中最瞩目的还是两点:

|

||||

|

||||

@@ -219,13 +219,13 @@ ICL(In-Context Learning,上下文学习)和 COT(Chain of Thought,思

|

||||

|

||||

虽然学界对此没有太大的共识,但其原理无非在于给予 LLMs 更翔实的上下文,让输出与输入有着更紧密的关联与惯性。(从某种意义上来说,也可以将其认为是一种图灵机式的编程)

|

||||

|

||||

> ICL:<br/>

|

||||

> ICL:<br/>

|

||||

|

||||

ICL 为输出增加惯性

|

||||

|

||||

> 可以简单认为,通过 ICL Prompt,能强化人类输入到机器输出的连贯性,借以提升输出的确定性。<br/>在经过“回答”的 finetune 之前,大模型的原始能力就是基于给定文本进行接龙,而 ICL 的引入则在“回答”这一前提条件下,降低了机器开始接龙这一步骤中的语义跨度,从而使得输出更加可控。<br/>

|

||||

|

||||

COT:<br/>

|

||||

COT:<br/>

|

||||

|

||||

COT 为输出增加关联

|

||||

|

||||

@@ -233,14 +233,13 @@ COT 为输出增加关联

|

||||

|

||||

进一步的,ICL 的发现,让 LLMs 能避免过多的传统 Finetune,轻易将能力运用在当前的情景中;COT 的发现,使得通过 LLMs 解决复杂问题成为可能。此二者的组合,为 LLMs 的通用能力打下了基础。

|

||||

|

||||

|

||||

## TaskMatrix.AI

|

||||

### TaskMatrix.AI

|

||||

|

||||

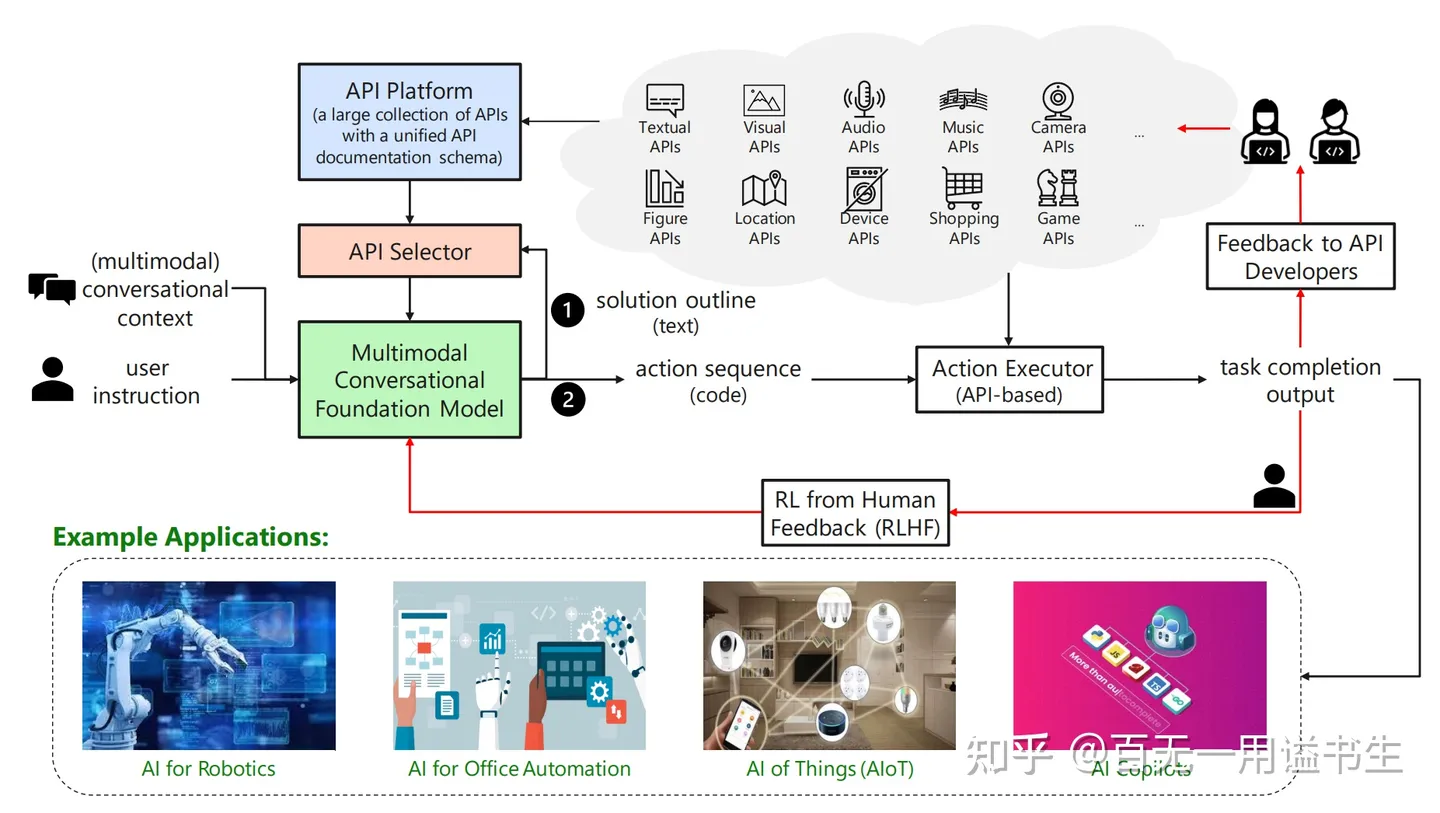

微软对 [TaskMatrix.AI](https://arxiv.org/abs/2303.16434) 这一项目的研究,很大程度上展示了 LLMs 基于 ICL 和 COT 所能展现的能力

|

||||

|

||||

(需要注意的是,TaskMatrix.AI 更大程度上是一个愿景向的调研案例,尚未正式落地生态)

|

||||

|

||||

|

||||

|

||||

|

||||

TaskMatrix 的生态愿景

|

||||

|

||||

@@ -261,7 +260,7 @@ TaskMatrix 的生态愿景

|

||||

|

||||

(当然,硬要说的话,对 ICL 和 COT 两种能力都有一个狭义与广义之争,但这不重要,因为我喜欢广义)

|

||||

|

||||

### ICL for TaskMatrix

|

||||

#### ICL for TaskMatrix

|

||||

|

||||

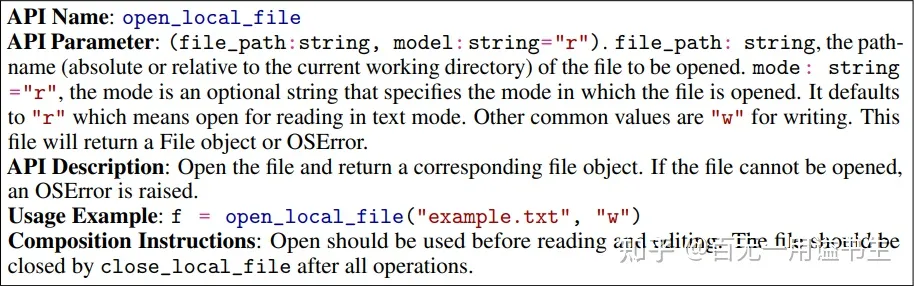

> 狭义的 ICL:从输入的既有样例中学习分布和规范<br/>广义的 ICL:有效的将输入内容有效运用到输出中

|

||||

|

||||

@@ -275,7 +274,7 @@ TaskMatrix 的生态愿景

|

||||

- Usage Example:API 的调用方法样例

|

||||

- Composition Instruction:API 的使用贴士,如应该与其它什么 API 组合使用,是否需要手动释放等

|

||||

|

||||

> 样例:打开文件 API<br/>

|

||||

> 样例:打开文件 API<br/>

|

||||

|

||||

基于此类文档内容和 ICL 的能力,LLMs 能从输入中习得调用 API 的方法,依此快速拓展了其横向能力

|

||||

|

||||

@@ -287,21 +286,21 @@ COT for TaskMatrix

|

||||

|

||||

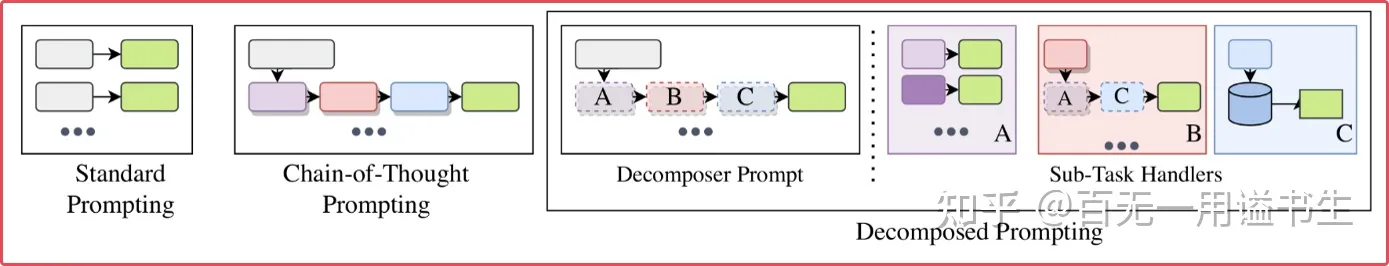

在 TaskMatirx 中,通过该模式,让 MCFM 将任务转化为待办大纲,并最终围绕大纲检索并组合 API,完成整体工作

|

||||

|

||||

> 样例:写论文<br/>构建完成工作大纲<br/>

|

||||

> 样例:写论文<br/>构建完成工作大纲<br/>

|

||||

|

||||

TaskMatrix 自动围绕目标拆解任务

|

||||

|

||||

> 自动调用插件和组件<br/>

|

||||

> 自动调用插件和组件<br/>

|

||||

|

||||

TaskMatrix 自动为任务创建 API 调用链

|

||||

|

||||

## 初步考察

|

||||

### 初步考察

|

||||

|

||||

基于上述的简单介绍,我们已经初步认识了 AI 在实际情景中的高度可用性

|

||||

|

||||

而接下来,我们继续从工程的角度揭示这种可用性的根源 —— 其源自一项通用的 Prompt 技术

|

||||

|

||||

# Prompt Decomposition:方法论

|

||||

## Prompt Decomposition:方法论

|

||||

|

||||

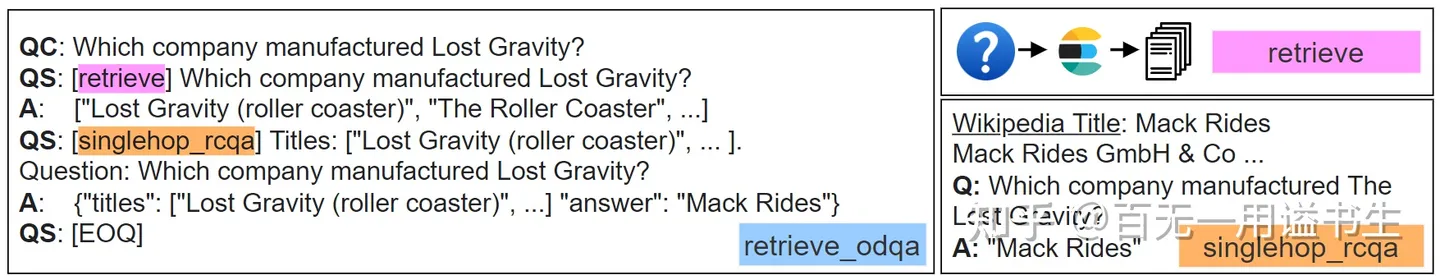

我们可以认为,TaskMatirx 的能力极大程度上依托于 Prompt Decomposition 的方法

|

||||

|

||||

@@ -309,11 +308,11 @@ TaskMatrix 自动为任务创建 API 调用链

|

||||

|

||||

[[2210.02406] Decomposed Prompting: A Modular Approach for Solving Complex Tasks (](https://arxiv.org/abs/2210.02406)[arxiv.org](https://arxiv.org/abs/2210.02406)[)](https://arxiv.org/abs/2210.02406)

|

||||

|

||||

## 原始 Decomp

|

||||

### 原始 Decomp

|

||||

|

||||

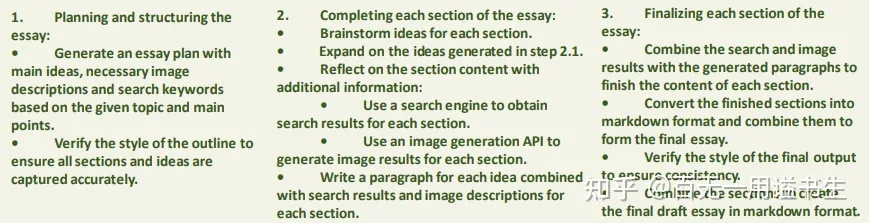

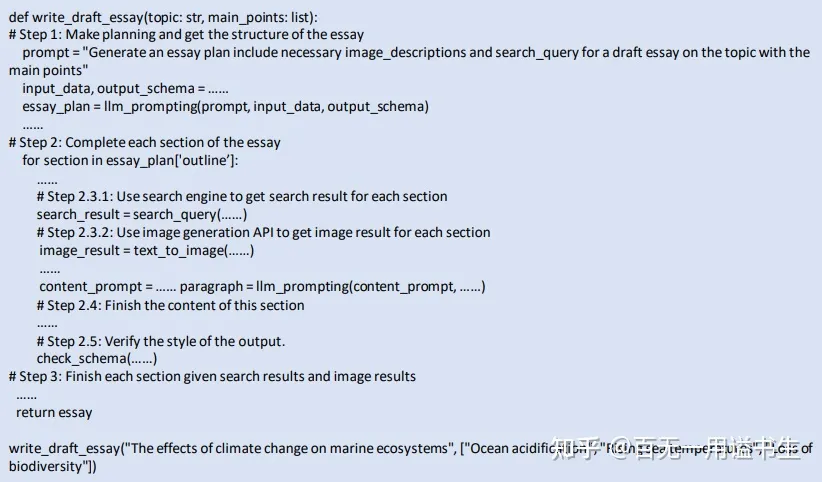

Decomp 的核心思想为将复杂问题通过 Prompt 技巧,将一个复杂的问题由 LLMs 自主划分为多个子任务。随后,我们通过 LLMs 完成多个任务,并将过程信息最终组合并输出理想的效果

|

||||

|

||||

|

||||

|

||||

|

||||

几种 Prompt 方法图示

|

||||

|

||||

@@ -321,13 +320,13 @@ Decomp 的核心思想为将复杂问题通过 Prompt 技巧,将一个复杂

|

||||

|

||||

而对于 Decomp 过程,则又是由一个原始的 Decomp Prompt 驱动

|

||||

|

||||

|

||||

|

||||

|

||||

Decomp 方法执行样例

|

||||

|

||||

在实际运行中,Decomp 过程由一个任务分解器,和一组程序解析器组成

|

||||

|

||||

其中分解器作为语言中枢,需要被授予如何分解复杂任务 —— 其将根据一个问题 Q 构建一个完整的提示程序 P ,这个程序包含一系列简单的子问题 Q_i,以及用于处理该子问题的专用函数 f_i(可以通过特定小型 LLM 或专用程序,也可以以更小的提示程序 P_i 形式呈现)。

|

||||

其中分解器作为语言中枢,需要被授予如何分解复杂任务 —— 其将根据一个问题 Q 构建一个完整的提示程序 P,这个程序包含一系列简单的子问题 Q_i,以及用于处理该子问题的专用函数 f_i(可以通过特定小型 LLM 或专用程序,也可以以更小的提示程序 P_i 形式呈现)。

|

||||

|

||||

模型将通过递归运行完整的提示程序,来获得理想的答案。

|

||||

|

||||

@@ -335,19 +334,19 @@ Decomp 方法执行样例

|

||||

|

||||

我们也可以认为,在每个子任务中,我们通过 Prompt 将 LLMs 的能力进行了劣化,从而让其成为一个专职的功能零件。而这种对单个 LLMs 能力迷信的削减,正延伸出了后续的发展趋势。

|

||||

|

||||

## Decomp 衍生

|

||||

### Decomp 衍生

|

||||

|

||||

Decomp 的原始功能实际上并不值得太过关注,但我们急需考虑,该方法还能用于处理些什么问题。

|

||||

|

||||

### 递归调用

|

||||

#### 递归调用

|

||||

|

||||

我们可以构建规则,让 Decomp 方法中的分解器递归调用自身,从而使得一个可能困难的问题无限细分,并最终得以解决

|

||||

|

||||

### 外部调用

|

||||

#### 外部调用

|

||||

|

||||

通过问题的分解和通过“专用函数”的执行,我们可以轻易让 LLMs 实现自身无法做到的调用 API 工作,例如主动从外部检索获取回答问题所需要的知识。

|

||||

|

||||

|

||||

|

||||

|

||||

Decomp 方法调用外部接口样例

|

||||

|

||||

@@ -355,11 +354,11 @@ Decomp 方法调用外部接口样例

|

||||

|

||||

基于此,我们还希望进一步研究基于这些机制能整出什么花活儿,并能讨论如何进一步利用 LLMs 的能力

|

||||

|

||||

## 回顾:HuggingGPT 对 Decomp 方法的使用

|

||||

### 回顾:HuggingGPT 对 Decomp 方法的使用

|

||||

|

||||

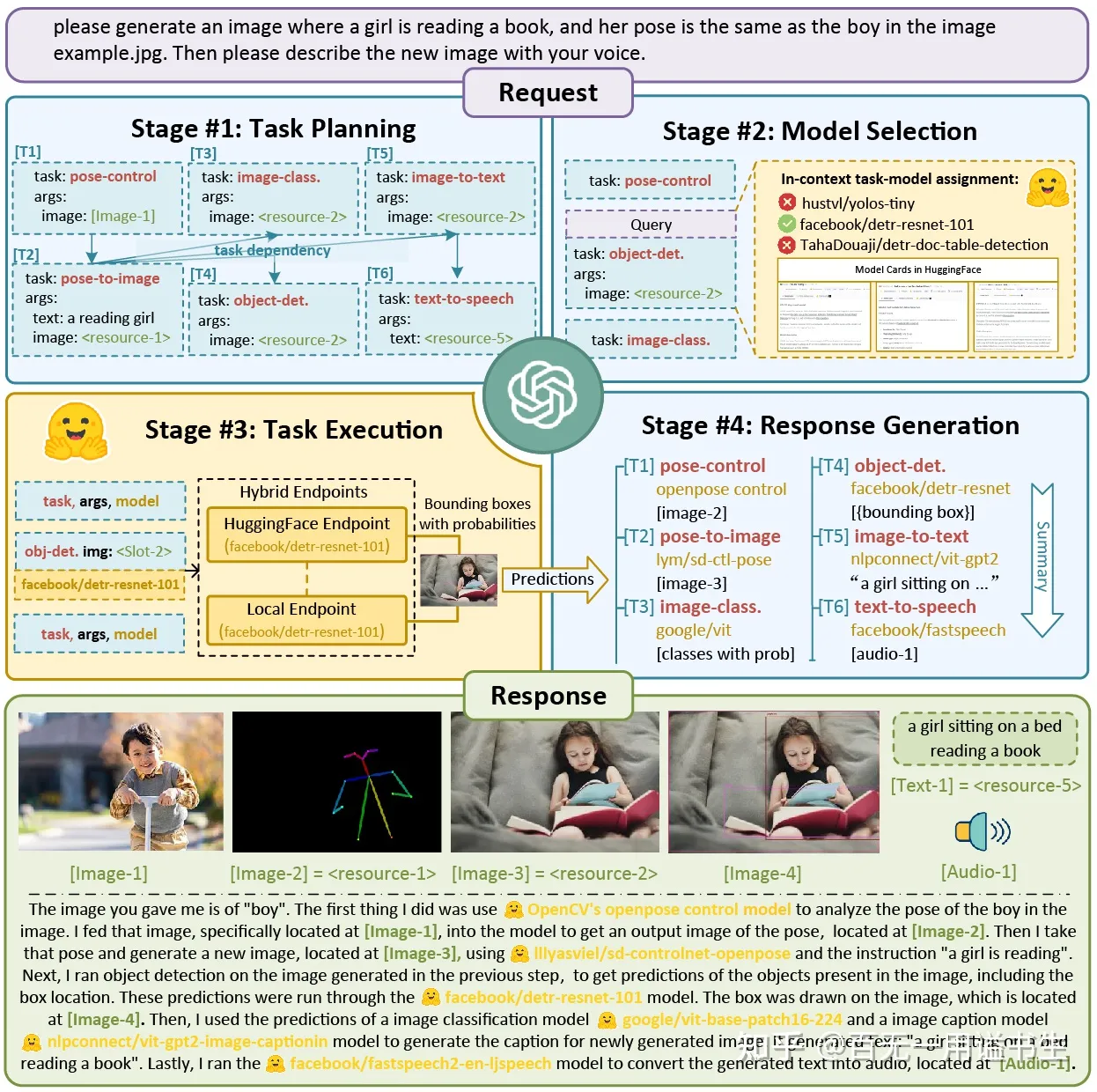

[HuggingGPT](https://arxiv.org/abs/2303.17580) 一文也许并未直接参考 Decomp 方法,而是用一些更规范的手法完成该任务,但其充分流水线化的 Prompt 工程无疑是 Decomp 方法在落地实践上的最佳注脚

|

||||

|

||||

|

||||

|

||||

|

||||

HuggingGPT

|

||||

|

||||

@@ -373,7 +372,7 @@ HuggingGPT

|

||||

|

||||

接下来,我们会讨论一个很新的,在为 Agent 模拟任务构建框架上,把 Decomp 和 Prompting 技术用到登峰造极的样例。

|

||||

|

||||

# Generative Agents:社群模拟实验

|

||||

## Generative Agents:社群模拟实验

|

||||

|

||||

[[2304.03442] Generative Agents: Interactive Simulacra of Human Behavior (](https://arxiv.org/abs/2304.03442)[arxiv.org](https://arxiv.org/abs/2304.03442)[)](https://arxiv.org/abs/2304.03442)

|

||||

|

||||

@@ -383,7 +382,7 @@ Generative Agents 一文通过的自然语言框架 AI 构建出了一个模拟

|

||||

|

||||

因为,其本质是一个信息管理框架的实验。

|

||||

|

||||

## 简要介绍

|

||||

### 简要介绍

|

||||

|

||||

简单介绍该项目构建的框架:

|

||||

|

||||

@@ -399,7 +398,7 @@ Generative Agents 构建了一套框架,让 NPC 可以感知被模块化的世

|

||||

|

||||

根据 NPC 的决策,NPC 能反向更新自身所使用的记忆数据库,并提炼总结出高层记忆供后续使用。

|

||||

|

||||

## 世界沙盒的构建

|

||||

### 世界沙盒的构建

|

||||

|

||||

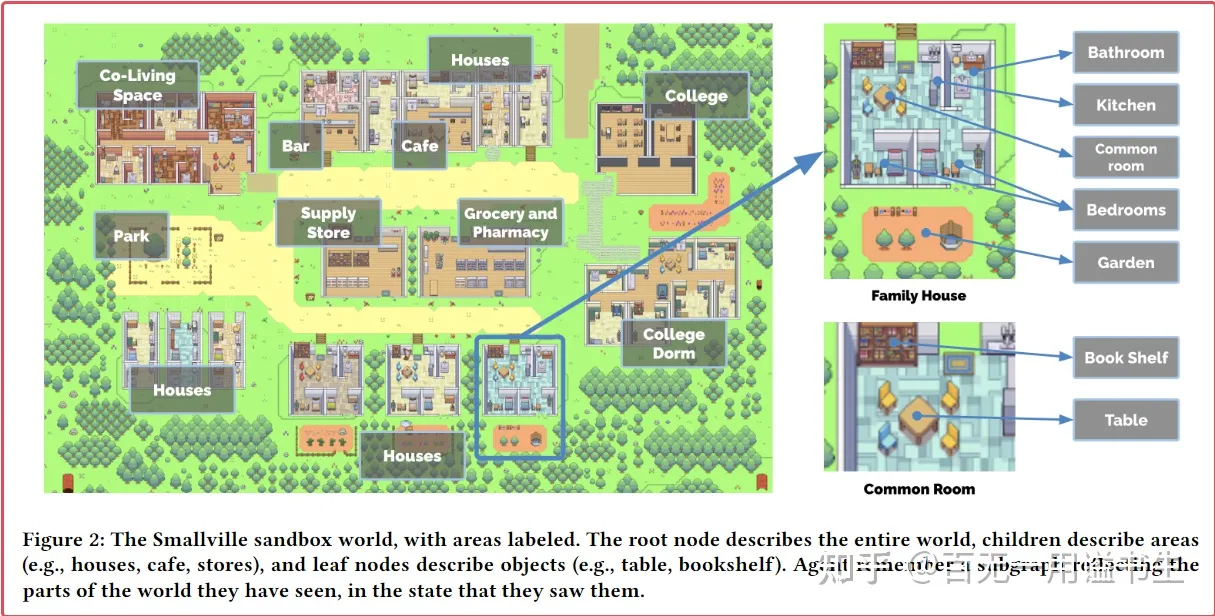

相比角色信息的构建是重头戏,世界沙盒的构建使用的方法要相对朴素一些

|

||||

|

||||

@@ -407,7 +406,7 @@ Generative Agents 构建了一套框架,让 NPC 可以感知被模块化的世

|

||||

|

||||

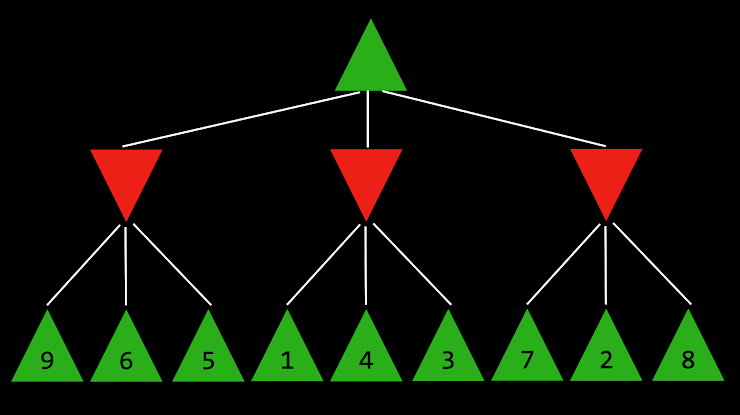

- 一方面,其包含场景中既有对象,包括建筑和摆件等的基础层级信息

|

||||

|

||||

|

||||

|

||||

|

||||

Generative Agents 的场景信息管理

|

||||

|

||||

@@ -419,7 +418,7 @@ Generative Agents 的场景信息管理

|

||||

|

||||

同时,空间信息会被自动组成自然语言 Prompt,用于帮助 Agent 更好地理解外部信息。甚至当 Agent 希望获取空间信息时,其能主动递归调用世界信息,从而让 NPC 能准确找到其希望抵达的叶子节点。

|

||||

|

||||

## Agent 构建

|

||||

### Agent 构建

|

||||

|

||||

模型中的 Agent 由 数据库 + LLMs 构建

|

||||

|

||||

@@ -431,13 +430,13 @@ Generative Agents 的场景信息管理

|

||||

|

||||

而对于过去经验的输入,则是文章的一大亮点

|

||||

|

||||

## 记忆模式

|

||||

### 记忆模式

|

||||

|

||||

对于 Agent 的记忆,依托于一个储存信息流的数据库

|

||||

|

||||

数据库中核心储存三类关键记忆信息 memory, planning and reflection

|

||||

|

||||

### Memory

|

||||

#### Memory

|

||||

|

||||

对于 Agent 每个时间步观测到的事件,会被顺序标记时间戳储存进记忆数据库中

|

||||

|

||||

@@ -449,11 +448,11 @@ Generative Agents 的场景信息管理

|

||||

|

||||

对于对记忆数据库进行索引的情况,会实时评估上述三个指标,并组合权重,返回对记忆索引内容的排序

|

||||

|

||||

### Reflection

|

||||

#### Reflection

|

||||

|

||||

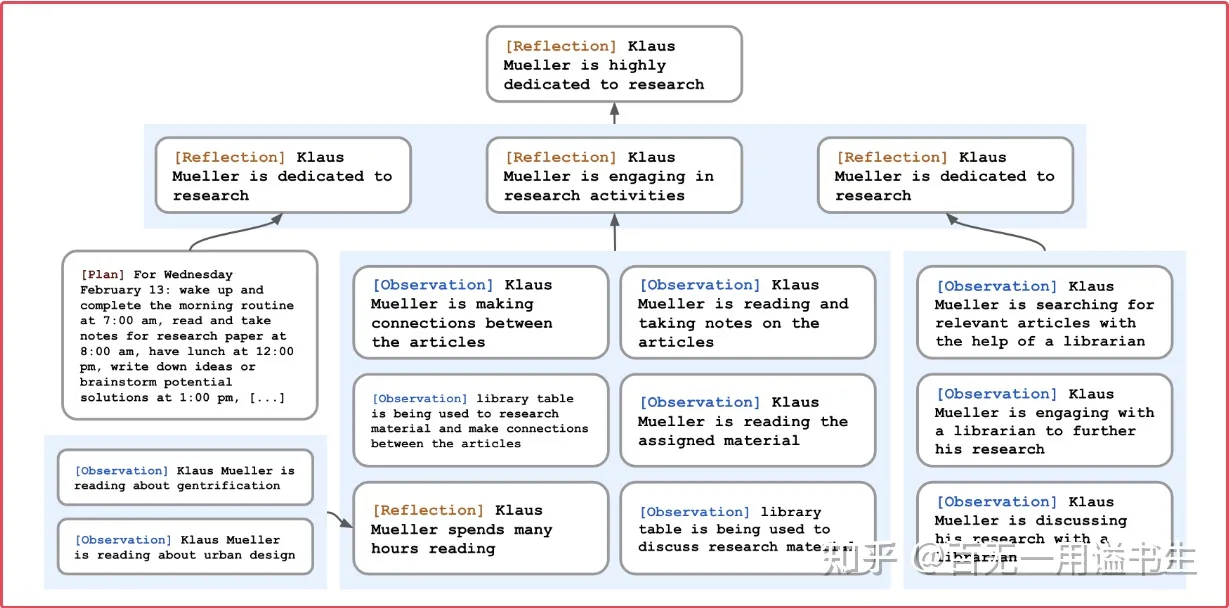

反思机制用于定期整理当前的 memory 数据库,让 npc 构建对世界和自身的高层认知

|

||||

|

||||

反思机制依靠一个自动的过程,反思-提问-解答

|

||||

反思机制依靠一个自动的过程,反思 - 提问 - 解答

|

||||

|

||||

在这个过程中,Agent 需要复盘自身所接受的记忆,并基于记忆对自己进行追问:

|

||||

|

||||

@@ -465,7 +464,7 @@ Generative Agents 的场景信息管理

|

||||

|

||||

进一步的,我们将这些洞察以相同的形式重新储存至记忆库中,由此模拟人类的记忆认知过程

|

||||

|

||||

### Planning

|

||||

#### Planning

|

||||

|

||||

Planning 的核心在于鼓励 Agent 为未来做出一定的规划,使得后续行动变得可信

|

||||

|

||||

@@ -475,13 +474,13 @@ Planning 的核心在于鼓励 Agent 为未来做出一定的规划,使得后

|

||||

|

||||

在此基础上,Agent 也需要对环境做出反应而调整自己的计划表(例如自身判断外界交互的优先级比当前计划更高。

|

||||

|

||||

## 交互构建

|

||||

### 交互构建

|

||||

|

||||

基于上述记忆框架,进一步实时让 Agent 自行感知并选择与其它 Agent 构建交互

|

||||

|

||||

并最终使得复杂的社群在交互中涌现

|

||||

|

||||

## 启发

|

||||

### 启发

|

||||

|

||||

Generative Agent 框架主要带来了一些启发,不止于 AI-NPC 的构建,其操作的诸多细节都是能进一步为我们在实际的工程中所延拓的。

|

||||

|

||||

@@ -497,7 +496,7 @@ Generative Agent 框架主要带来了一些启发,不止于 AI-NPC 的构建

|

||||

- AI x 信息自动化系统的构建:基于 AI + 软件系统而非基于人工对数据进行收集和管理

|

||||

- etc...

|

||||

|

||||

# AutoGPT:自动化的智能软件系统

|

||||

## AutoGPT:自动化的智能软件系统

|

||||

|

||||

[Torantulino/Auto-GPT: An experimental open-source attempt to make GPT-4 fully autonomous. (](https://github.com/Torantulino/Auto-GPT)[github.com](https://github.com/Torantulino/Auto-GPT)[)](https://github.com/Torantulino/Auto-GPT)[github.com/Torantulino/Auto-GPT](https://github.com/Torantulino/Auto-GPT)

|

||||

|

||||

@@ -530,7 +529,7 @@ AutoGPT 主要特性如下:

|

||||

|

||||

(如下是 AutoGPT 的基础 Prompt)

|

||||

|

||||

```

|

||||

```txt

|

||||

[

|

||||

{

|

||||

'content': 'You are Eliza, an AI designed to write code according to my requirements.\n'

|

||||

@@ -613,11 +612,11 @@ AutoGPT 主要特性如下:

|

||||

]

|

||||

```

|

||||

|

||||

# 回归正题:AI 作为智能系统

|

||||

## 回归正题:AI 作为智能系统

|

||||

|

||||

作为正题的回归,我们需要重新考虑什么是一个 AI,一个能帮助我们的 AI 应当处于什么样的现实形态?

|

||||

|

||||

<em>我们需要的 </em><em>AI</em><em> 仅仅是大语言模型吗?如果是,它能帮我们做什么呢?如果不是,那 AI 的实质是什么呢?</em>

|

||||

*我们需要的 **AI** 仅仅是大语言模型吗?如果是,它能帮我们做什么呢?如果不是,那 AI 的实质是什么呢?*

|

||||

|

||||

我首先武断地认为,我们需要的 AI,并不是一个语言模型实体,而是一个复杂智能系统

|

||||

|

||||

@@ -625,9 +624,9 @@ AutoGPT 主要特性如下:

|

||||

|

||||

接下来,我们会围绕此进行展开

|

||||

|

||||

## 意识理论之于 AI:全局工作空间理论

|

||||

### 意识理论之于 AI:全局工作空间理论

|

||||

|

||||

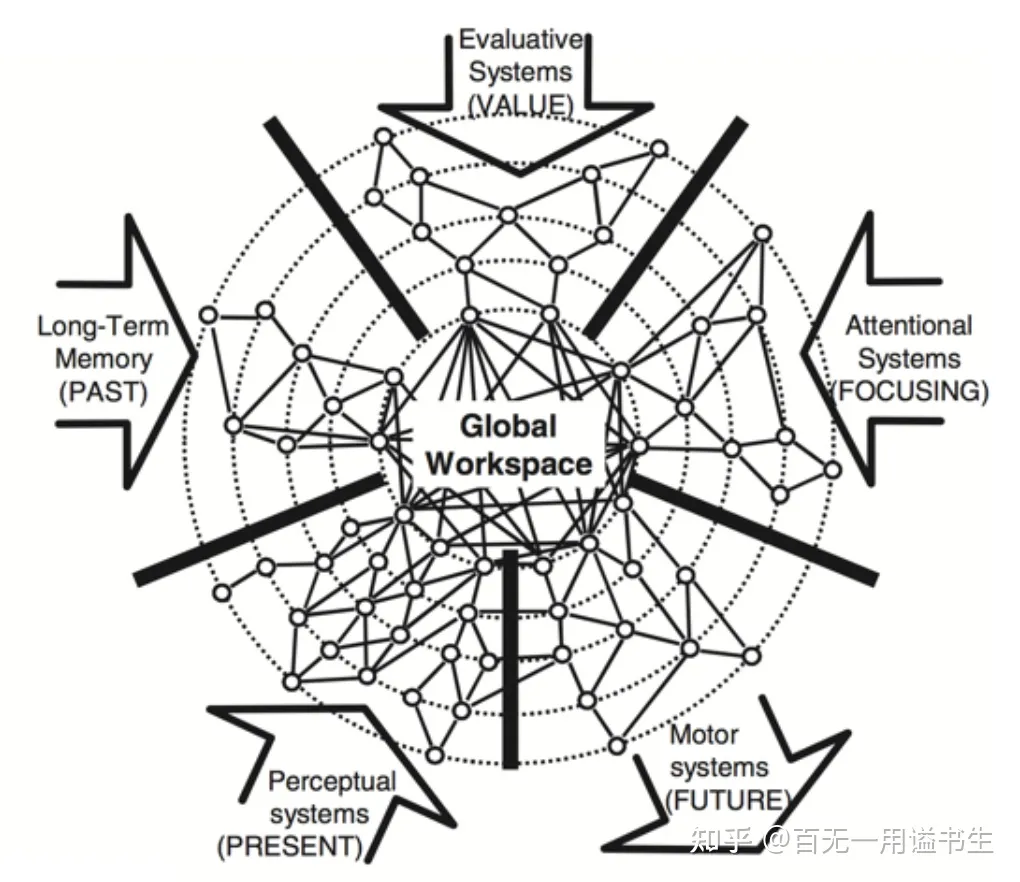

全局工作空间理论(英语:Global workspace theory,GWT)是美国心理学家[伯纳德·巴尔斯](https://zh.wikipedia.org/w/index.php?title=%E4%BC%AF%E7%BA%B3%E5%BE%B7%C2%B7%E5%B7%B4%E5%B0%94%E6%96%AF&action=edit&redlink=1)提出的[意识](https://zh.wikipedia.org/wiki/%E6%84%8F%E8%AF%86)模型。该理论假设意识与一个全局的“广播系统”相关联,这个系统会在整个大脑中广播资讯。大脑中专属的智能处理器会按照惯常的方式自动处理资讯,这个时候不会形成[意识](https://zh.wikipedia.org/wiki/%E6%84%8F%E8%AF%86)。当人面对新的或者是与习惯性刺激不同的事物时,各种专属智能处理器会透过合作或竞争的方式,在全局工作空间中对新事物进行分析以获得最佳结果,而意识正是在这个过程中得以产生。

|

||||

全局工作空间理论(英语:Global workspace theory,GWT)是美国心理学家伯纳德·巴尔斯提出的[意识](https://zh.wikipedia.org/wiki/%E6%84%8F%E8%AF%86)模型。该理论假设意识与一个全局的“广播系统”相关联,这个系统会在整个大脑中广播资讯。大脑中专属的智能处理器会按照惯常的方式自动处理资讯,这个时候不会形成[意识](https://zh.wikipedia.org/wiki/%E6%84%8F%E8%AF%86)。当人面对新的或者是与习惯性刺激不同的事物时,各种专属智能处理器会透过合作或竞争的方式,在全局工作空间中对新事物进行分析以获得最佳结果,而意识正是在这个过程中得以产生。

|

||||

|

||||

这通常被认为是 神经科学家接受度最高的哲学理论

|

||||

|

||||

@@ -635,7 +634,7 @@ AutoGPT 主要特性如下:

|

||||

|

||||

其提醒我们,就连我们的意识主体性,也只是陈述自我的一个表述器而已。我们是否应当反思对语言能力的过度迷信,从而相信我们能通过训练模型构建 All in One 的智能实体?

|

||||

|

||||

|

||||

|

||||

|

||||

全局工作空间理论

|

||||

|

||||

@@ -649,7 +648,7 @@ AutoGPT 主要特性如下:

|

||||

- 知觉系统(现在)

|

||||

- 运动系统(未来)

|

||||

|

||||

### 例子:意识系统 For Generative Agent

|

||||

#### 例子:意识系统 For Generative Agent

|

||||

|

||||

单独解释的话,或许会比较麻烦,毕竟我对认知科学并不专业

|

||||

|

||||

@@ -671,9 +670,9 @@ AutoGPT 主要特性如下:

|

||||

|

||||

当然,我个人对该问题的认知与 GPT4 并非完全相同,包括注意系统与运动系统的部分。但其实我并不一定需要将所有东西全都呈现出来,因为在框架上它已然如此。

|

||||

|

||||

记忆、评估、反思这几块的设计通过 Prompt 把 LLMs 劣化成专用的智能处理器单元, 并系统性实现信息的整合与输出。从整体的观点上来看,Generative Agents 中的 Agent,其主体性并不在于 LLM,而是在于这个完整的系统。(相应的,LLMs 只是这个系统的运算工具和陈述工具)

|

||||

记忆、评估、反思这几块的设计通过 Prompt 把 LLMs 劣化成专用的智能处理器单元,并系统性实现信息的整合与输出。从整体的观点上来看,Generative Agents 中的 Agent,其主体性并不在于 LLM,而是在于这个完整的系统。(相应的,LLMs 只是这个系统的运算工具和陈述工具)

|

||||

|

||||

### 例子:AutoGPT 的考察

|

||||

#### 例子:AutoGPT 的考察

|

||||

|

||||

我们再从相同的角度考察 AutoGPT 这一项目:

|

||||

|

||||

@@ -690,7 +689,7 @@ AutoGPT 主要特性如下:

|

||||

|

||||

这也对应 AutoGPT 虽然看似有着极强的能力,但实际智能效果又不足为外人道也

|

||||

|

||||

## 构建一个什么样的智能系统

|

||||

### 构建一个什么样的智能系统

|

||||

|

||||

再次回归正题,Generative Agents 和 AutoGPT 这两个知名项目共同将 AI 研究从大模型能力研究导向了智能系统能力研究。而我们也不能驻足不前,我们应当更积极地考虑我们对于一个 AI 智能体有着什么样的需求,也对应我们需要构建、要怎么构建一个基于 LLMs 语言能力的可信可用的智能系统。

|

||||

|

||||

@@ -708,7 +707,7 @@ AutoGPT 主要特性如下:

|

||||

|

||||

这些问题都在指导、质问我们究竟需要一个怎样的智能系统。

|

||||

|

||||

# 予智能以信息:难题与展望

|

||||

## 予智能以信息:难题与展望

|

||||

|

||||

回到最开始的话题,我们构建一个可用智能系统的基底,依旧是信息系统

|

||||

|

||||

@@ -724,7 +723,7 @@ AutoGPT 主要特性如下:

|

||||

|

||||

而接下来,我们希望对其进行逐一评估,讨论他们各自将作用的形式,讨论他们需要做到哪一步,又能做到哪一步。

|

||||

|

||||

## 知觉系统:构建 AI 可读的结构化环境

|

||||

### 知觉系统:构建 AI 可读的结构化环境

|

||||

|

||||

知觉系统负责让智能体实现信息的感知,其中也包括对复杂输入信息的解析

|

||||

|

||||

@@ -752,7 +751,7 @@ AutoGPT 所使用的 Commands 接口中,就有很大一部分接口用于实

|

||||

- args: "file": `"<file>"`

|

||||

- 读取文件并解析文本数据

|

||||

|

||||

这些访问接口由程序集暴露给 GPT ,将知觉系统中实际使用的微观处理器隐藏在了系统框架之下

|

||||

这些访问接口由程序集暴露给 GPT,将知觉系统中实际使用的微观处理器隐藏在了系统框架之下

|

||||

|

||||

AutoGPT 所实际感知的信息为纯文本的格式,得益于以开放性 Web 为基础的网络世界环境,AutoGPT 能较方便地通过搜索(依赖于搜索引擎 API)和解析 html 文件(依赖于软件辅助,GPT 难以自行裁剪 html 中过于冗杂的格式信息),从而有效阅读绝大多数互联网信息。

|

||||

|

||||

@@ -804,7 +803,7 @@ Generative Agents 的知觉设计:关联性难题

|

||||

|

||||

仅就这方面而言,作为一个方向性的倡议,对知觉系统的开发可能分为以下步骤

|

||||

|

||||

### <em>数据处理/管理</em>

|

||||

#### *数据处理/管理*

|

||||

|

||||

- 对 办公文件/数据 构建通用读取接口

|

||||

- 以同类信息为单位,设计通用的字段(由人设计和管理,AI 能力尚不至此)

|

||||

@@ -828,7 +827,7 @@ Generative Agents 的知觉设计:关联性难题

|

||||

- 如储存进 mongoDB

|

||||

- (设计孪生数据的自动更新机制)

|

||||

|

||||

### <em>知觉系统驱动</em>

|

||||

#### *知觉系统驱动*

|

||||

|

||||

- 基于上述索引数据库,以视图为单位进行访问,并设计 视图 2 Prompt 的转化格式

|

||||

|

||||

@@ -847,7 +846,7 @@ Generative Agents 的知觉设计:关联性难题

|

||||

|

||||

- 对于 Agent 开启的指定任务线程(区分于主线程的感知模块),其起始 Prompt 可能呈这样的形式

|

||||

|

||||

> <br/>如上是你的目标,为了实现这个目标,你可能需要获取一系列的信息,为了帮助你获得信息,我会为你提供一系列的索引访问接口,请你通过如下格式输出语句让我为你返回信息。<br/>注:如果你请求错误,请你阅读返回的报错信息以自我纠正<br/>例:<br/>< 通过接口名称检索("接口名称")><br/>< 通过接口功能检索("访问网页")><br/>< 通过父级名称检索("父级名称")>

|

||||

> <br/>如上是你的目标,为了实现这个目标,你可能需要获取一系列的信息,为了帮助你获得信息,我会为你提供一系列的索引访问接口,请你通过如下格式输出语句让我为你返回信息。<br/>注:如果你请求错误,请你阅读返回的报错信息以自我纠正<br/>例:<br/>< 通过接口名称检索 ("接口名称")><br/>< 通过接口功能检索 ("访问网页")><br/>< 通过父级名称检索 ("父级名称")>

|

||||

|

||||

- 为 GPT 设计自动化指令解析与执行模块

|

||||

|

||||

@@ -861,7 +860,7 @@ Generative Agents 的知觉设计:关联性难题

|

||||

|

||||

> TBD:号被 OpenAI 噶了,我也很绝望啊

|

||||

|

||||

## 工作记忆:组织 AI 记忆系统

|

||||

### 工作记忆:组织 AI 记忆系统

|

||||

|

||||

记忆系统的构成其实相较知觉系统等更为抽象,它用于管理 AI 运行时作为背景的长期记忆,以及定义决定了 AI 当前任务及目标的短期记忆。

|

||||

|

||||

@@ -869,9 +868,9 @@ Generative Agents 的知觉设计:关联性难题

|

||||

|

||||

但我们依旧能从前人的工作中获得一定的参考。

|

||||

|

||||

### AutoGPT 的记忆设计:粗放但有效

|

||||

#### AutoGPT 的记忆设计:粗放但有效

|

||||

|

||||

在 长时记忆(过去)、评估系统(价值)、注意系统(关注) 这三个要素中,AutoGPT 做得比较好的无疑只有第一个。

|

||||

在 长时记忆(过去)、评估系统(价值)、注意系统(关注)这三个要素中,AutoGPT 做得比较好的无疑只有第一个。

|

||||

|

||||

AutoGPT 的核心记忆设计依赖于预包装的 Prompt 本体,这一包装包含如下部分:

|

||||

|

||||

@@ -899,15 +898,15 @@ AutoGPT 的核心记忆设计依赖于预包装的 Prompt 本体,这一包装

|

||||

|

||||

但从另一角度,其“自主将收集到的信息写入记忆”这一功能作为一个 以完成任务为目标 的 Agent 而言无疑是非常合适的架构设计。

|

||||

|

||||

### Generative Agents 的记忆设计:精心构建的金字塔

|

||||

#### Generative Agents 的记忆设计:精心构建的金字塔

|

||||

|

||||

区别于 AutoGPT 主动写入的记忆,Generative Agents 的记忆源自被动的无限感知和记录,因此显得更加没有目的性。也正因如此,其需要一种更妥善的管理形式。

|

||||

|

||||

Generative Agent 通过自动化评估记忆的价值,并构建遗忘系统、关注系统等用于精准从自己繁杂的记忆中检索对于当前情景有用的信息。

|

||||

|

||||

|

||||

|

||||

|

||||

Generative Agents :基于 Reflection 构建记忆金字塔

|

||||

Generative Agents:基于 Reflection 构建记忆金字塔

|

||||

|

||||

进一步的,其通过反思机制强化了记忆的价值,使得高层洞察从既有记忆的连结中涌现,这一机制通常被用于将 信息转化为知识,并构建出了有效记忆的金字塔。

|

||||

|

||||

@@ -915,7 +914,7 @@ Generative Agents :基于 Reflection 构建记忆金字塔

|

||||

|

||||

相关的更有效的记忆管理无疑很快就会被更新的项目学习。

|

||||

|

||||

### 记忆系统的构建讨论(放飞大脑)

|

||||

#### 记忆系统的构建讨论(放飞大脑)

|

||||

|

||||

但从某种意义上来说,对于一个我们希望其帮助我们工作的智能体而言,像 Generative Agent 这般的巨大数据库也许并未有充分的价值,何况我们所输入的内容原始层级就较高(这一层可能在前面的知觉系统中,就让一定程度上的高层洞见自主产生了),不易于进一步的堆叠。

|

||||

|

||||

@@ -933,7 +932,7 @@ Generative Agents :基于 Reflection 构建记忆金字塔

|

||||

|

||||

(可以遇见的,以 AutoGPT 的热度,半个月内就会有人为其设计相应的 mod)

|

||||

|

||||

## 运动系统:让 AI 可及一切

|

||||

### 运动系统:让 AI 可及一切

|

||||

|

||||

基于知觉系统和记忆系统,已经能构建一个使用语言解决问题的智能体了。但最为关键的改造世界部分则依旧缺席。

|

||||

|

||||

@@ -943,7 +942,7 @@ Generative Agents :基于 Reflection 构建记忆金字塔

|

||||

|

||||

- 我们大胆假设未来游戏中的 Agent 能通过 API 驱动自身在场景中无拘无束(拼装行为树

|

||||

- 再大胆假设他们能使用 API 实时把需求的内容转化为发布给玩家的任务(拼装任务节点

|

||||

- 继续大胆假设, AI 根据我的需求把今天要配的啥比表直接配完,当场下班(笑

|

||||

- 继续大胆假设,AI 根据我的需求把今天要配的啥比表直接配完,当场下班(笑

|

||||

|

||||

(而这一切,都是可能,且近在眼前的)

|

||||

|

||||

@@ -963,7 +962,7 @@ AI 能做的一切都基于我们的赋予,包括语言能力,包括思维

|

||||

- 我们不该将其当作独立的智能体看待,但能在其基础上通过构建系统创建智能 Agent

|

||||

- 为此,我们需要通过信息工程,让 AI 能够真正感知和改造世界,从而改变我们的生产进程

|

||||

|

||||

# 寄予厚望

|

||||

## 寄予厚望

|

||||

|

||||

感谢有人忍受了我阴间的行文和一路跑偏的思路,真能看到这里

|

||||

|

||||

|

||||

262

4.人工智能/4.12LLMAgent之结构化输出.md

Normal file

@@ -0,0 +1,262 @@

|

||||

# LLM Agent 之结构化输出

|

||||

|

||||

author:Marlene

|

||||

|

||||

*Last revised 2023/07/26*

|

||||

|

||||

## 引言

|

||||

|

||||

自去年年底以来,GPT 的迅速发展诞生了一系列大模型。出现了更新、更大、更强的 GPT-4。OpenAI 不断推出 GPT-4,ChatGPT Plugins,代码解释器,Function calling,图片处理等等。7 月的 WAIC 上,笔者也有幸见到了国内一众企业相继展示自家的大模型。在这段时间里,LLM 从最初的 PE 工程走向智能体交互。而笔者从最开始考虑 LLM 能不能多人协作,思考”一个专家完成所有任务好还是很多人分工完成好“,到各种论文层出不穷,到如今火热的 LLM Agent 开发模式。可以说,如果你从大学里随便问某个人都知道 GPT,甚至大部分都用过。

|

||||

|

||||

好了,前言少叙。进入正题。众所周知,Agent 基本= LLM(大型语言模型)+ 记忆 + 规划技能 + 工具使用。

|

||||

|

||||

想要使用工具,让 GPT 掌握如何使用工具,常见的方法是告知 GPT 工具(通常是一个可以调用的函数)的参数,让 GPT 生成这些参数即可。那么如何让 GPT 可靠的生成这些规定的参数呢?换一种说法,如何让 GPT 输出结构化的数据信息呢?

|

||||

|

||||

## 原理及相关框架

|

||||

|

||||

现如今大部分的结构化输出工具的原理都是:告诉 GPT 要输出一个怎么样的结构即可。没错~当然,为什么会出现这么多开发工具都用来解决这个问题,明明是一个简单的原理呢?

|

||||

|

||||

```txt

|

||||

1. 通过 prompt 告知 LLM 我们所需要的返回格式,并进行生成。

|

||||

2. 通过一些规则来检查返回结果,如果不符合格式,生成相关错误信息。

|

||||

3. 将上一次的生成内容和检查的错误信息告知 LLM,进行下一次的修正生成。

|

||||

4. 重复 2-3 步骤,直到生成的内容完全符合我们的要求。

|

||||

```

|

||||

|

||||

首先,关于怎样描述这样一个结构的 prompt 模板,众口难调。有些人认为结构就应该用自然语言描述,这样足够简单,上手难度足够低,方便快速迭代开发。有些人认为结构描述?JSON Schema 不就够了?有些人觉得 YAML 也可以。有些人觉得上面这些对于我的需求还是够不着啊,于是自己造了一个伪代码描述。

|

||||

其次,自动处理修正机制也可以做很多文章。还有许多对性能和开销的优化。

|

||||

下文就是关于一众框架的简单分析。希望会对选择困难症的你有所帮助。

|

||||

|

||||

### **guardrails**

|

||||

|

||||

guardrails 这个项目,就是将上述的步骤做了进一步的抽象与封装,提供更加 high level 的配置与 API 来完成整个过程。

|

||||

优点:

|

||||

|

||||

1. 定义了一套 RAIL spec

|

||||

2. 更聚焦于错误信息

|

||||

|

||||

```markdown

|

||||

<rail version="0.1">

|

||||

|

||||

<output>

|

||||

<object name="patient_info">

|

||||

<string name="gender" description="Patient's gender" />

|

||||

<integer name="age" format="valid-range: 0 100" />

|

||||

<list

|

||||

name="symptoms"

|

||||

description="Symptoms that the patient is currently experiencing. Each symptom should be classified into a separate item in the list.">

|

||||

<object>

|

||||

<string name="symptom" description="Symptom that a patient is experiencing"/>

|

||||

<string

|

||||

name="affected area"

|

||||

description="What part of the body the symptom is affecting"

|

||||

format="valid-choices: {['head', 'neck', 'chest']}"

|

||||

on-fail-valid-choices="reask"

|

||||

/>

|

||||

</object>

|

||||

</list>

|

||||

<list name="current_meds" description="Medications the patient is currently taking and their response">

|

||||

<object>

|

||||

<string name="medication" description="Name of the medication the patient is taking" />

|

||||

<string

|

||||

name="response"

|

||||

description="How the patient is responding to the medication"

|

||||

/>

|

||||

</object>

|

||||

</list>

|

||||

</object>

|

||||

</output>

|

||||

|

||||

<prompt>

|

||||

|

||||

Given the following doctor's notes about a patient, please extract a dictionary that contains the patient's information.

|

||||

|

||||

{{doctors_notes}}

|

||||

|

||||

@complete_json_suffix_v2

|

||||

</prompt>

|

||||

</rail>

|

||||

```

|

||||

|

||||

可以看到,guardrails 定义了一套类似 xml 的语言用于结构化输出,又结合了自然语言的 prompt。虽然比起常见的模板语言要更加“繁琐”,但可以包含的内容也可以更加完善。比如可以提供字段的描述信息,检查规范,一定程度上也能帮助 LLM 更好地理解需求,生成预期的结果。

|

||||

|

||||

```markdown

|

||||

I was given the following JSON response, which had problems due to incorrect values.

|

||||

|

||||

{

|

||||

"patient_info": {

|

||||

"symptoms": [

|

||||

{

|

||||

"affected area": {

|

||||

"incorrect_value": "face & hair",

|

||||

"error_message": "Value face & hair is not in choices ['head', 'neck', 'chest']."

|

||||

}

|

||||

},

|

||||

{

|

||||

"affected area": {

|

||||

"incorrect_value": "beard, eyebrows & nares",

|

||||

"error_message": "Value beard, eyebrows & nares is not in choices ['head', 'neck', 'chest']."

|

||||

}

|

||||

}

|

||||

]

|

||||

}

|

||||

}

|

||||

|

||||

Help me correct the incorrect values based on the given error messages.

|

||||

```

|

||||

|

||||

后续 LLM 的返回可以仅针对这部分问题的修正,而不需要再重复生成整个 json。生成的新结果会由 guardrails 再自动填写回原来的位置,非常丝滑。除了 json 格式的检查外,RAIL spec 中还提供了通过脚本检查的扩展支持,可以用来检查更加复杂的内容,例如 Python 代码是否合法,结果中是否有敏感信息,甚至通过 LLM 再来检查生成的内容是否有害,做结果过滤等。

|

||||

|

||||

### **NeMo-Guardrails**

|

||||

|

||||

来自 Nvidia 的一个同名项目,其目标相比 guardrails 更有野心,想要确保 LLM 应用整体的可信度,无害性以及数据安全性等,而不仅仅只是输出的结构化检查和修复。因此其实现思路上也复杂不少,设计了一种专门的 Colang 语言,来支持更加通用多样的业务流,而不仅仅是生成 -> 检查 -> 修复。不过它的设计都是基于对话做的。实际开发应用可能不太合适。

|

||||

|

||||

```markdown

|

||||

define user ask capabilities

|

||||

"What can you do?"

|

||||

"What can you help me with?"

|

||||

"tell me what you can do"

|

||||

"tell me about you"

|

||||

"How can I use your help?"

|

||||

|

||||

define flow

|

||||

user ask capabilities

|

||||

bot inform capabilities

|

||||

|

||||

define bot inform capabilities

|

||||

"I am an AI assistant which helps answer questions based on a given knowledge base. For this interaction, I can answer question based on the job report published by US Bureau of Labor Statistics."

|

||||

```

|

||||

|

||||

从代码可以看出其结合了 python 和自然语言,方便相似度检索。

|

||||

其整体的运作流程如下:

|

||||

|

||||

1. 根据用户输入识别用户意图。在这一步,系统会将用户的输入在 flow 定义的各种用户回复文本中做相似性查找,也就是上面文件中“What can you do?”这一连串内容。这些检索到的预设用户意图内容,结合其它信息如对话样例,最近聊天记录等,形成整体的 prompt,发给 LLM 来生成回复。最终再从回复中提取用户意图。

|

||||

2. 根据意图,判断下一步操作动作。这一步有两种做法,一是当前的状态能够匹配上预定义的 flow。例如用户就是提了一个 bot 能力的问题,那么就会匹配上面定义的 user ask capabilities,下一步动作自然就是 bot inform capabilities。如果没有匹配上,就要由 LLM 自己来决定下一步动作,这时候也会跟生成用户意图一样,对于 flow 定义做一个相似性查找,将相关信息发给 LLM 来做生成。

|

||||

3. 生成 bot 回复。如果上一步生成的 bot 回复意图已经有明确定义了(例如上面的 bot 能力的回复),那么就直接用预定义的回复内容来回复用户。如果没有,就跟生成用户意图一样,做意图的相似性查找,将相关信息给 LLM 来生成回复。注意到很多动态的问题例如 QA 场景,是很难预先定义好回复内容的,这里也支持对接知识库,同样是做 vector search 之后,将相关 context 信息发给 LLM 来生成具体回复。

|

||||

|

||||

### guidance

|

||||

|

||||

之前在 guardrails 中的做法是在 prompt 中给出说明和示范,希望 LLM 能够遵循指令来输出。但现实中往往会出现各种问题,例如额外带了一些其它的文字说明,或者生成的 json 格式不正确等,所以需要后续的 ReAsk 来进行修正。LangChain 里也提供了各种 output parser 来帮忙提取回复中的结构化信息部分,但也经常容易运行失败。

|

||||

|

||||

在 guidance 中,也是通过“模板语言”来定义 LLM 的输出结构,以确保输出格式的正确性。

|

||||

|

||||

```markdown

|

||||

# load a model locally (we use LLaMA here)

|

||||

guidance.llm = guidance.llms.Transformers("your_local_path/llama-7b", device=0)

|

||||

|

||||

# we can pre-define valid option sets

|

||||

valid_weapons = ["sword", "axe", "mace", "spear", "bow", "crossbow"]

|

||||

|

||||

# define the prompt

|

||||

program = guidance("""The following is a character profile for an RPG game in JSON format.

|

||||

json

|

||||

{

|

||||

"description": "{{description}}",

|

||||

"name": "{{gen 'name'}}",

|

||||

"age": {{gen 'age' pattern='[0-9]+' stop=','}},

|

||||

"armor": "{{#select 'armor'}}leather{{or}}chainmail{{or}}plate{{/select}}",

|

||||

"weapon": "{{select 'weapon' options=valid_weapons}}",

|

||||

"class": "{{gen 'class'}}",

|

||||

"mantra": "{{gen 'mantra'}}",

|

||||

"strength": {{gen 'strength' pattern='[0-9]+' stop=','}},

|

||||

"items": [{{#geneach 'items' num_iterations=3}}

|

||||

"{{gen 'this'}}",{{/geneach}}

|

||||

]

|

||||

}""")

|

||||

|

||||

# execute the prompt

|

||||

program(description="A quick and nimble fighter.", valid_weapons=valid_weapons)

|

||||

```

|

||||

|

||||

在之前传统的做法中,这一整个 json 都需要由 LLM 来生成。但是 json 的结构是我们预先定义的,例如有哪些字段,开闭的花括号等,其实都不需要 LLM 来生成。

|

||||

优点:

|

||||

|

||||

1. 生成的 json 结构是保证合法且可控的,不会出现语法错误或者缺失/错误字段等。

|

||||

2. 通过 LLM 生成的 token 数量减少了,理论上可以提升生成速度。

|

||||

|

||||

除了 prompt 模板,它还提供了:

|

||||

|

||||

- 支持 hidden block,例如 LLM 的一些推理过程可能并不需要暴露给最终用户,就可以灵活利用这个特性来生成一些中间结果。

|

||||

- Generation caching,自动把已经生成过的结果缓存起来,提升速度。

|

||||

- 支持 HuggingFace 模型的 guidance acceleration,进一步提升生成速度。

|

||||

- Token healing,不看这个我还不知道 LLM 有这种问题……

|

||||

- Regex pattern guide,在模板的基础上进一步通过正则表达来限定生成的内容规范。

|

||||

|

||||

从项目代码来看,还是有比较浓的“research 味道”的,可读性并不好。实际测试结果也比较翻车。

|

||||

|

||||

### lmql

|

||||

|

||||

在 guidance 的基础上,lmql 这个项目进一步把“prompt 模板”这个概念推进到了一种新的编程语言。从官网能看到给出的一系列示例。语法结构看起来有点像 SQL,但函数与缩进都是 Python 的风格。

|

||||

|

||||

从支持的功能来看,相比 guidance 毫不逊色。例如各种限制条件,代码调用,各种 caching 加速,工具集成等基本都具备。这个框架的格式化输出是其次,其各种可控的输出及语言本身或许更值得关注。

|

||||

|

||||

### TypeChat

|

||||

|

||||

TypeChat 将 prompt 工程替换为 schema 工程:无需编写非结构化的自然语言 prompt 来描述所需输出的格式,而是编写 TS 类型定义。TypeChat 可以帮助 LLM 以 JSON 的形式响应,并且响应结果非常合理:例如用户要求将这句话「我可以要一份蓝莓松饼和一杯特级拿铁咖啡吗?」转化成 JSON 格式,TypeChat 响应结果如下:

|

||||

|

||||

其本质原理是把 interface 之类的 ts 代码作为 prompt 模板。因此它不仅可以对输出结果进行 ts 校验,甚至能够输入注释描述,不可谓非常方便 js 开发者。不过,近日 typechat 爆火,很多开发者企图尝试将 typechat 移植到 python,笔者认为这是缘木求鱼,因为其校验本身依赖的是 ts。笔者在开发过程中,将 typechat 融合到自己的库中,效果不错。但是它本身自带的 prompt 和笔者输入的 prompt 还是存在冲突,还是需要扣扣源码。

|

||||

|

||||

### Langchain

|

||||

|

||||

如果你关注了过去几个月中人工智能的爆炸式发展,那你大概率听说过 LangChain。简单来说,LangChain 是一个 Python 和 JavaScript 库,由 Harrison Chase 开发,用于连接 OpenAI 的 GPT API(后续已扩展到更多模型)以生成人工智能文本。

|

||||

|

||||

langchain 具有特别多的结构化输出工具。例如使用 yaml 定义 Schema,输出结构化 JSON。使用 zodSchema 定义 Schema,输出结构化 JSON。使用 FunctionParameters 定义 Schema,输出结构化 JSON。

|

||||

|

||||

但是笔者这里不打算介绍 langchain。究其原因,是笔者被 langchain 折磨不堪。明明可以几行代码写清楚的东西,langchain 可以各种封装,花了好几十行才写出来。更何况,笔者是用 ts 开发,开发时甚至偷不了任何懒,甚至其文档丝毫不友好。这几天,《机器之心》发布文章表示放弃 langchain。要想让 LangChain 做笔者想让它做的事,就必须花大力气破解它,这将造成大量的技术负担。因为使用人工智能本身就需要花费足够的脑力。LangChain 是为数不多的在大多数常用情况下都会增加开销的软件之一。所以笔者建议非必要,不使用 langchain。

|

||||

|

||||

## LLM 对于结构化信息的理解

|

||||

|

||||

LLM 的可控性、稳定性、事实性、安全性等问题是推进企业级应用中非常关键的问题,上面分享的这些项目都是在这方面做了很多探索,也有很多值得借鉴的地方。总体思路上来说,主要是:

|

||||

|

||||

- 提供一套 prompt 模板定义,允许用户指定 LLM 生成的格式或内容主题。

|

||||

- 在模板基础上,也有不少项目进一步设计了相应的编程语言,让 LLM 与确定性程序的交互更加直观。

|

||||

- 提供各类 validator,保证生成内容符合预期,并且提供了自动处理/修正机制。

|

||||

- 更进一步,也可以在生成前进行干预,例如在 prompt 中给近似案例,修改模型 decode 时的概率分布等。

|

||||

- 其它在可控性基础上做的各种性能与开销的优化,例如缓存,减少 token 消耗量,对开源模型能力的挖掘等。

|

||||

|

||||

即使我们不直接使用上述的项目做开发,也可以从中学习到很多有用的思路。当然也非常期待这个领域出现更多有意思的想法与研究,以及 prompt 与编程语言结合能否碰撞出更多的火花。

|

||||

|

||||

同时笔者认为自动处理机制、自己设计的编程语言等等内容,随着时间发展,一定会层出不穷,不断迭代更新。笔者抛去这些时效性较弱的内容,从描述信息和位置信息两方面思考 peompt 模板该如何设计,当然只是浅浅的抛砖引玉一下。

|

||||

|

||||

### 描述信息

|

||||

|

||||

到底哪种方式更容易于 LLM 去理解?我们不谈框架的设计,只考虑 prompt 的设计。上述框架关于这方面有一些参考,例如有些直接拿 json 作为 prompt 模板,有些拿 xml 作为 prompt 模板,有些拿自己设计的语言作为 prompt,有些拿自然语言作为 prompt 模板。时至今日,选用哪种最适合 LLM 去理解格式化的信息,输出格式化的内容完全没有盖棺定论。甚至时至今日,格式化输出问题还是没有得到可靠稳定的解决,要不然笔者肯定不会介绍这么多框架实践了。

|

||||

|

||||

笔者认为不管哪种方式,都可以从两个方面考量:更简单,更结构。如果想要在开发的时候更简单,或者在使用时更简单,选择 md、yaml 方式描述结构化信息更合适。如果想要更结构化的方式,选择 json、xml、ts,输出都能更有结构,甚至之后做结构校验都更方便。

|

||||

|

||||

想要 LLM 结构化输出更加稳定和理想,笔者认为选择 prompt 模板时必须考虑每个字段是否有足够的辅助信息。例如 xml 描述时,每个标签都有一个描述属性描述这个标签时什么意思。

|

||||

|

||||

#### 额外引申

|

||||

|

||||

笔者之前在开发 LLM 应用时,也曾思考类似的问题。笔者需要将多模态的数据进行结构化的标注,方便 LLM 去理解。但是标注成什么样却是一个很大的难题。笔者选择的是 JSON。但是,关于里面许多内容的标注。笔者在众多方案中徘徊。在细节处深挖,如何设计一种既简单,又能表示各种结构复杂关系,还能够节约 token 的方案及其的难。

|

||||

> 关于后续如何解决,请容笔者卖个关子 sai~

|

||||

|

||||

### 位置信息

|

||||

|

||||

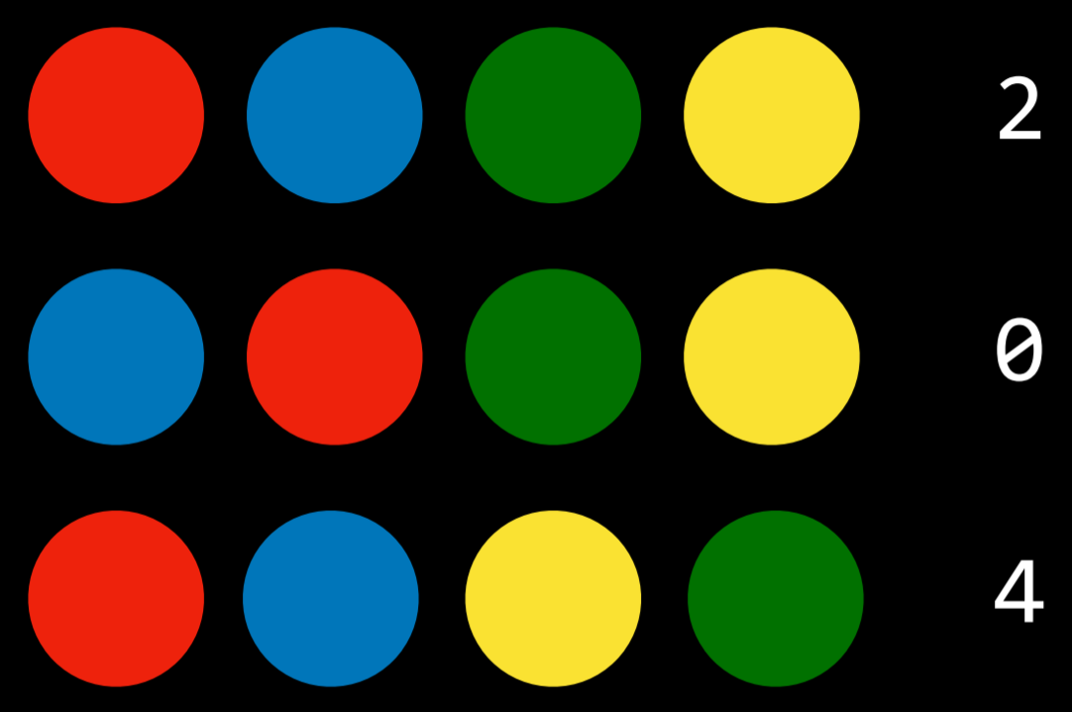

是否有人注意到 llm 对于关键信息在 prompt 中的位置会对结果产生影响呢?在设计 prompt 方面,人们通常建议为语言模型提供详尽的任务描述和背景信息。近期的一些语言模型有能力输入较长的上下文,但它究竟能多好地利用更长的上下文?这一点却相对少有人知。近日,有学者研究发现如果上下文太长,语言模型会更关注其中的前后部分,中间部分却几乎被略过不看,导致模型难以找到放在输入上下文中部的相关信息。下文部分是该论文一些核心内容:

|

||||

|

||||

这是由其本身训练和结构设计有关的,但却对于我们开发有着莫大的帮助和指导意义。

|

||||

|

||||

相比之下,在多文档问答任务上,查询感知型上下文化的影响很小。特别指出,当相关信息位于输入上下文的最开始时,它可以提高性能,但在其他设置中会稍微降低性能。借此,我们可以认为,将重要的信息放在开头,结尾放置结构化模板,或许是一种优质选择。

|

||||

|

||||

那么如果真的为其提供这么多 token,那会真的有用吗?这个问题的答案是:由下游任务决定。因为这取决于所添加上下文的边际价值以及模型有效使用长输入上下文的能力。所以如果能有效地对检索文档排序(让相关信息与输入上下文的起始处更近)或对已排序的列表进行截断处理(必要时返回更少的文档),那么也许可以提升基于语言模型的阅读器使用检索上下文的能力。

|

||||

|

||||

## 题外话

|

||||

|

||||

之前,妙鸭相机突然爆火。其只需 9.9 即可生成同款数字分身,效果拔群。但是很多人发现,其生成的内容极其容易造成肖像权侵犯,这显然是有问题的。更有甚至的是,用户发现妙鸭相机的用户协议存在问题。根据该应用最初版本的用户服务协议,用户需授权妙鸭相机在全世界(包括元宇宙等虚拟空间)范围内享有永久的、不可撤销的、可转让的、可转授权的、免费的和非独家的许可,使得妙鸭相机可以任何形式、任何媒体或技术(无论现在已知或以后开发)使用用户的内容。对于上述内容,妙鸭相机称系“为了使我方能够提供、确保和改进本服务(包括但不限于使用 AI 生成内容作为再训练数据等)”。

|

||||

|

||||

一句话理解,就是你的肖像它随便用,与你无关。

|

||||

|

||||

这不禁让我联想到一部非常发人深省的剧作:《黑镜》。它的第六季第一集讲述的同样是隐私的问题。该集中,主人公的生活隐私由于同意了用户协议,被无时无刻搜集。然后当天晚上就发现流媒体电视上居然出现了跟她同名的电视剧,内容与它当天的生活一模一样,台词甚至更加夸张。于是她的不方便公之于众的生活变得一塌涂地,但她甚至没有办法打官司,因为肯定会输。更令人深省的是,电视剧的主人公是 AI 生成的视频,其肖像确是根据现实存在的明星生成的。那位明星也无法对她的肖像有任何权利。这样一个荒诞的故事,但是仔细想想,却又非常可能发生。

|

||||

|

||||

如今的社会出现了各种大模型。大模型的发展必定需要大数据的支撑。企业为了盈利必定会想方设法的搜集数据,然后肆意使用,转卖。而很多用户对此不自知,更有甚至是非常乐意。例如抖音、B 站,当你对其交互时,你希望它推荐更适合你的视频,它也在搜集你的数据,这是明知且主动的。

|

||||

|

||||

隐私的掠夺是无声的。你认为你的一下点击是没啥价值的隐私数据,殊不知这正中了资本家的下怀。几年前,我也是这样的。高中的大门出现了闸机,可以刷脸进校园。我当时以为这需要像手机解锁一样需要扫描人脸 ID。结果发现,我可以直接进去,闸机上甚至会出现我的照片。我仔细看了看,发现是我入学的证件照。原来一张照片就能刷脸进校园。原来就连学校也可以不经同学同意,将照片用作其他用途。那更何况其他的呢。

|

||||

我想,未来,这样的隐私问题会越来越多。

|

||||

|

||||

## 参考

|

||||

|

||||

<https://mp.weixin.qq.com/s?__biz=MzA3MzI4MjgzMw==&mid=2650885029&idx=4&sn=ac01576a8957b41529dd3c877d262d5e&chksm=84e48fdbb39306cd8979a4fa7f7da14a9428dc28ccc47880d668ef6293b1a8b7b0964569ec36&mpshare=1&scene=23&srcid=0725w9FPsVnOOzkPGPB7lH8h&sharer_sharetime=1690303766527&sharer_shareid=d2396b329b12f49d34967e2b183540dd#rd>

|

||||

<https://mp.weixin.qq.com/s/BngY2WgCcpTOlvdyBNJxqA>

|

||||

<https://microsoft.github.io/TypeChat/>

|

||||

<https://mp.weixin.qq.com/s?__biz=MzA3MzI4MjgzMw==&mid=2650885029&idx=4&sn=ac01576a8957b41529dd3c877d262d5e&chksm=84e48fdbb39306cd8979a4fa7f7da14a9428dc28ccc47880d668ef6293b1a8b7b0964569ec36&mpshare=1&scene=23&srcid=0725w9FPsVnOOzkPGPB7lH8h&sharer_sharetime=1690303766527&sharer_shareid=d2396b329b12f49d34967e2b183540dd#rd>

|

||||

@@ -12,7 +12,7 @@

|

||||

|

||||

无数伟大的科学家究其一生的研究和探索它,但是你发现本章内容少有相关内容,还是以深度学习为主?为什么?

|

||||

|

||||

## 原因一:时代的浪潮

|

||||

## 原因一:时代的浪潮

|

||||

|

||||

近乎全民深度学习的浪潮下,机器学习的知识被科研界一而再再而三的抛掷脑后,大家争先恐后的刷点,并使用深度学习的解决问题,因此深度学习领域的知识材料得到了井喷式的增长,而少有人愿意投入非常长的时间去研究机器学习的每一条数学公式的背后机理。

|

||||

|

||||

@@ -34,7 +34,7 @@ ZZM 曾经尝试过投入大量时间去钻研数学以及机器学习相关的

|

||||

|

||||

如果你阅览了本章节的数学相关知识和内容以及拓展感觉非常感兴趣并且毫无压力的话,我推荐你尝试去啃一啃大家公认的困难的书籍,比如说著名的花书,互联网上,社区内也有大量的辅助材料来帮助你更进一步的入门

|

||||

|

||||

# 科研导向明显

|

||||

## 科研导向明显

|

||||

|

||||

整篇教程大范围的在教怎么从科研角度去理解一些知识,感觉和工业上的逻有不符之处。

|

||||

|

||||

@@ -48,7 +48,7 @@ ZZM 曾经尝试过投入大量时间去钻研数学以及机器学习相关的

|

||||

|

||||

因此如果你对这方面感兴趣,可能你需要别的途径去获取更多的思考和资源了。

|

||||

|

||||

# 繁杂的知识内容

|

||||

## 繁杂的知识内容

|

||||

|

||||

这点非常抱歉,AI 领域的知识本身就是网状的,复杂的,甚至是互相引用的,这点会导致不可避免的内容变得冗长。

|

||||

|

||||

@@ -56,8 +56,11 @@ ZZM 曾经尝试过投入大量时间去钻研数学以及机器学习相关的

|

||||

|

||||

而不是别人强行灌输给你的

|

||||

|

||||

# 还有更多???

|

||||

## 还有更多???

|

||||

|

||||

联系 ZZM,我努力改

|

||||

::: tip 邮箱

|

||||

1264517821@qq.com

|

||||

:::

|

||||

|

||||

|

||||

<img src=https://cdn.xyxsw.site/boxcnfYSoVgoERduiWP0jWNWMxf.jpg width=200>

|

||||

@@ -1,65 +1,72 @@

|

||||

# 对AI大致方向的概述

|

||||

# 对 AI 大致方向的概述

|

||||

|

||||

## 前言

|

||||

|

||||

# 前言

|

||||

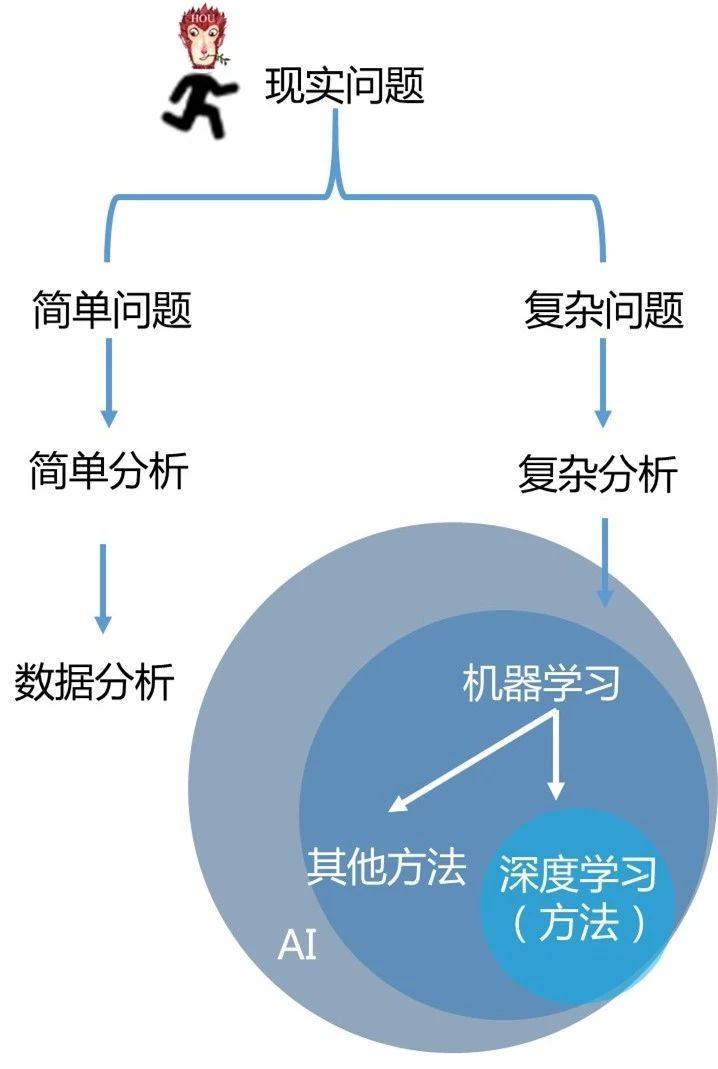

在这个时代,相关内容是非常泛滥的,我们在本章内容中,大致的写一些目前比较有名的方向以及它的简介(也许会比 wiki 和百度有趣一点?)

|

||||

|

||||

在这个时代,相关内容是非常泛滥的,我们在本章内容中,大致的写一些目前比较有名的方向以及它的简介(也许会比wiki和百度有趣一点?)

|

||||

|

||||

# 深度学习 的大致方向分类

|

||||

## 深度学习 的大致方向分类

|

||||

|

||||

本模块会粗略地介绍目前审读学习的研究与应用领域,在这里提前说明:笔者也只是一名普通的杭电学生,视野与认知有限,某些领域我们了解较多就会介绍地更加详细,某些领域了解较少或笔者中无人从事相关研究,就难免会简略介绍甚至有所偏颇,欢迎大家的指正。

|

||||

|

||||

## CV(计算机视觉)

|

||||

### CV(计算机视觉)

|

||||

|

||||

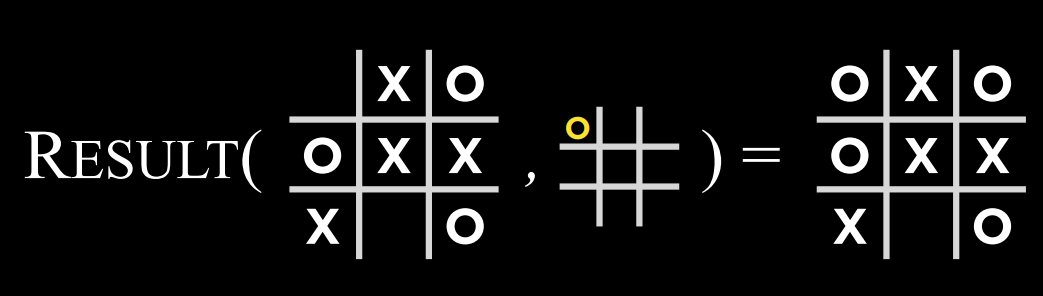

计算机视觉旨在<strong>用计算机模拟人类处理图片信息的能力</strong>,就比如这里有一张图片——手写数字 9

|

||||

计算机视觉旨在**用计算机模拟人类处理图片信息的能力**,就比如这里有一张图片——手写数字 9

|

||||

|

||||

|

||||

|

||||

|

||||

对我们人类而言,能够很轻松地知道这张图片中包含的信息(数字 9),而对计算机来说这只是一堆像素。计算机视觉的任务就是让计算机能够从这堆像素中得到‘数字 9’这个信息。

|

||||

|

||||

相信你通过上面简单的介绍应该能够了解到计算机视觉是在干嘛了,接下来我会举几个相对复杂的例子来让大家了解一下目前的 cv 是在做怎样的研究:

|

||||

|

||||

<strong>图像分割</strong>是在图片中对物体分类,并且把它们所对应的位置标示出来。下图就是把人的五官,面部皮肤和头发分割出来,效(小)果(丑)图如下:

|

||||

::: warning 🐱 **图像分割**是在图片中对物体分类,并且把它们所对应的位置标示出来。下图就是把人的五官,面部皮肤和头发分割出来,效 (小) 果 (丑) 图如下:

|

||||

:::

|

||||

|

||||

|

||||

<table>

|

||||

<tr>

|

||||

<td><img src=https://cdn.xyxsw.site/boxcnxn5GlJZmsrMV5qKNwMlDPc.jpg width=175></td>

|

||||

<td><img src=https://cdn.xyxsw.site/boxcnokdWGegr2XCi1vfg0ZZiWg.png width=200></td>

|

||||

<td><img src=https://cdn.xyxsw.site/boxcn2o9ilOZg6jI6ssTYWhoeme.png width=200></td>

|

||||

</tr>

|

||||

</table>

|

||||

|

||||

|

||||

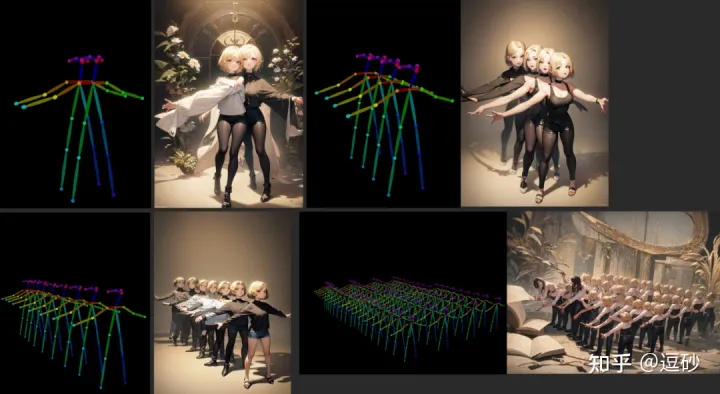

::: warning 🐱 **图像生成**相信大家一定不陌生,NovalAI 在 2022 年火的一塌糊涂,我觉得不需要我过多赘述,对它 (Diffusion model) 的改进工作也是层出不穷,这里就放一张由可控姿势网络 (ControlNet) 生成的图片吧:

|

||||

:::

|

||||

|

||||

|

||||

|

||||

|

||||

<strong>图像生成</strong>相信大家一定不陌生,NovalAI 在 2022 年火的一塌糊涂,我觉得不需要我过多赘述,对它(Diffusion model)的改进工作也是层出不穷,这里就放一张由可控姿势网络(ControlNet)生成的图片吧:

|

||||

::: warning 🐱 **三维重建**也是很多研究者关注的方向,指的是传入对同一物体不同视角的照片,来生成 3D 建模的任务。这方面比图像处理更加前沿并且难度更大。具体见[4.6.5.4 神经辐射场 (NeRF)](4.6.5.4%E7%A5%9E%E7%BB%8F%E8%BE%90%E5%B0%84%E5%9C%BA(NeRF).md) 章节。

|

||||

:::

|

||||

|

||||

|

||||

如果对计算机视觉有兴趣,可以通过以下路线进行学习:深度学习快速入门—> 经典网络。本块内容的主要撰写者之一**SRT 社团**多数成员主要从事 CV 方向研究,欢迎与我们交流。

|

||||

|

||||

<strong>三维重建</strong>也是很多研究者关注的方向,指的是传入对同一物体不同视角的照片,来生成 3D 建模的任务。这方面比图像处理更加前沿并且难度更大。具体见[4.6.5.4神经辐射场(NeRF)](4.6.5.4%E7%A5%9E%E7%BB%8F%E8%BE%90%E5%B0%84%E5%9C%BA(NeRF).md) 章节。

|

||||

### NLP(自然语言处理)

|

||||

|

||||

如果对计算机视觉有兴趣,可以通过以下路线进行学习:深度学习快速入门—> 经典网络。本块内容的主要撰写者之一<strong>SRT 社团</strong>多数成员主要从事 CV 方向研究,欢迎与我们交流。

|

||||

这就更好理解了,让计算机能够像人类一样,理解文本中的“真正含义”。在计算机眼中,文本就是单纯的字符串,NLP 的工作就是把字符转换为计算机可理解的数据。举个例子,ChatGPT(或者 New Bing) 都是 NLP 的成果。在过去,NLP 领域被细分为了多个小任务,比如文本情感分析、关键段落提取等。而 ChatGPT 的出现可以说是集几乎所有小任务于大成,接下来 NLP 方向的工作会向 ChatGPT 的方向靠近。

|

||||

|

||||

## NLP(自然语言处理)

|

||||

<table>

|

||||

<tr>

|

||||

<td><img src=https://cdn.xyxsw.site/boxcnyh6pakAkcxCKq6pLylSdef.png width=580></td>

|

||||

<td><img src=https://cdn.xyxsw.site/boxcnwWnoEDulgWdqGkY0WeYogc.png width=200></td>

|

||||

</tr>

|

||||

</table>

|

||||

|

||||

这就更好理解了,让计算机能够像人类一样,理解文本中的“真正含义”。在计算机眼中,文本就是单纯的字符串,NLP 的工作就是把字符转换为计算机可理解的数据。举个例子,ChatGPT(或者 New Bing)都是 NLP 的成果。在过去,NLP 领域被细分为了多个小任务,比如文本情感分析、关键段落提取等。而 ChatGPT 的出现可以说是集几乎所有小任务于大成,接下来 NLP 方向的工作会向 ChatGPT 的方向靠近。

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

## 多模态(跨越模态的处理)

|

||||

### 多模态 (跨越模态的处理)

|

||||

|

||||

模态,可以简单理解为数据形式,比如图片是一种模态,文本是一种模态,声音是一种模态,等等……

|

||||

|

||||

而多模态就是让计算机能够将不同模态的信息相对应,一种常用的方法就是让计算机把图片的内容和文本的内容理解为相同的语义(在这个领域一般用一个较长的向量来表示语义)。

|

||||

|

||||

也就是说我<strong>传入一张狗子的照片经过模型得到的向量</strong>与<strong>DOG 这个单词经过模型得到的向量</strong>相近。

|

||||

也就是说我**传入一张狗子的照片经过模型得到的向量**与**DOG 这个单词经过模型得到的向量**相近。

|

||||

|

||||

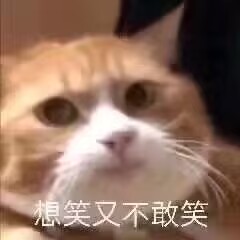

具体的任务比如说<strong>图片问答</strong>,传入一张图片,问 AI 这张图片里面有几只猫猫,它们是什么颜色,它告诉我有一只猫猫,是橙色的:

|

||||

具体的任务比如说**图片问答**,传入一张图片,问 AI 这张图片里面有几只猫猫,它们是什么颜色,它告诉我有一只猫猫,是橙色的:

|

||||

|

||||

|

||||

|

||||

|

||||

## 对比学习

|

||||

### 对比学习

|

||||

|

||||

因为传统 AI 训练一般都需要数据集标注,比如说图片分割数据集需要人工在数万张图片上抠出具体位置,才能进行训练,这样的人力成本是巨大的,而且难以得到更多数据。因此,对比学习应运而生,这是一种不需要进行标注或者只需要少量标注的训练方式,具体可见[4.6.8对比学习](4.6.8%E5%AF%B9%E6%AF%94%E5%AD%A6%E4%B9%A0.md) 。

|

||||

因为传统 AI 训练一般都需要数据集标注,比如说图片分割数据集需要人工在数万张图片上抠出具体位置,才能进行训练,这样的人力成本是巨大的,而且难以得到更多数据。因此,对比学习应运而生,这是一种不需要进行标注或者只需要少量标注的训练方式,具体可见[4.6.8 对比学习](4.6.8%E5%AF%B9%E6%AF%94%E5%AD%A6%E4%B9%A0.md) 。

|

||||

|

||||

## 强化学习

|

||||

### 强化学习

|

||||

|

||||

强调模型如何依据环境(比如扫地机器人在学习家里的陈设,这时陈设就是环境)的变化而改进,以取得最大的收益(比如游戏得到最高分)。

|

||||

|

||||

@@ -67,25 +74,26 @@

|

||||

|

||||

强化学习主要理论来源于心理学中的动物学习和最优控制的控制理论。说的通俗点,强化学习就是操控智能体与环境交互、去不断试错,在这个过程中进行学习。因此,强化学习被普遍地应用于游戏、资源优化分配、机器人等领域。强化学习本身已经是个老东西了,但是和深度学习结合之后焕发出了第二春——深度强化学习(DRL)。

|

||||

|

||||

深度强化学习最初来源是2013年谷歌DeepMind团队发表的《Playing Atari with Deep Reinforcement Learning》一文,正式提出Deep Q-network(DQN)算法。在这篇论文中,DeepMind团队训练智能体Agent玩雅达利游戏,并取得了惊人的成绩。事实上,深度强化学习最为人熟知的成就是AlphaGO Zero,它没有使用任何人类棋谱进行训练,训练了三天的成就就已经超过了人类几千年的经验积累<del>导致柯洁道心破碎</del>。

|

||||

深度强化学习最初来源是 2013 年谷歌 DeepMind 团队发表的《Playing Atari with Deep Reinforcement Learning》一文,正式提出 Deep Q-network(DQN)算法。在这篇论文中,DeepMind 团队训练智能体 Agent 玩雅达利游戏,并取得了惊人的成绩。事实上,深度强化学习最为人熟知的成就是 AlphaGO Zero,它没有使用任何人类棋谱进行训练,训练了三天的成就就已经超过了人类几千年的经验积累<del>导致柯洁道心破碎</del>。

|

||||

|

||||

# 交叉学科&经典机器学习算法

|

||||

## 交叉学科&经典机器学习算法

|

||||

|

||||

交叉学科巨大的难度在于你往往需要掌握多个学科以及其相对应的知识。

|

||||

|

||||

举个例子:如果你想要做出一个可以识别病人是否得了某种疾病,现在你得到了一批数据,你首先得自己可以标注出或者找到这个数据中,哪些是有问题的,并且可以指明问题在哪,如果你想分出更具体的,比如具体哪里有问题,那你可能甚至需要熟悉他并且把他标注出来。

|

||||

|

||||

目前其实全学科都有向着AI走的趋势,例如量化金融,医疗,生物科学(nature的那篇有关氨基酸的重大发现真的很cool)。他们很多都在用非常传统的机器学习算法,甚至有的大公司的算法岗在处理某些数据的时候,可能会先考虑用最简单的决策树试一试

|

||||

目前其实全学科都有向着 AI 走的趋势,例如量化金融,医疗,生物科学 (nature 的那篇有关氨基酸的重大发现真的很 cool)。他们很多都在用非常传统的机器学习算法,甚至有的大公司的算法岗在处理某些数据的时候,可能会先考虑用最简单的决策树试一试

|

||||

|

||||

当然,在大语言模型出现的趋势下,很多学科的应用会被融合会被简化会被大一统(科研人的崇高理想),但是不得不提的是,传统的机器学习算法和模型仍然希望你能去了解甚至更进一步学习。

|

||||

当然,在大语言模型出现的趋势下,很多学科的应用会被融合会被简化会被大一统 (科研人的崇高理想),但是不得不提的是,传统的机器学习算法和模型仍然希望你能去了解甚至更进一步学习。

|

||||

|

||||

除了能让你了解所谓前人的智慧,还可以给你带来更进一步的在数学思维,算法思维上的提高。

|

||||

|

||||

# And more?

|

||||

## And more?

|

||||

|

||||

我们对AI的定义如果仅仅只有这些内容,我认为还是太过于狭隘了,我们可以把知识规划,知识表征等等东西都可以将他划入AI的定义中去,当然这些还期待着你的进一步探索和思考~

|

||||

我们对 AI 的定义如果仅仅只有这些内容,我认为还是太过于狭隘了,我们可以把知识规划,知识表征等等东西都可以将他划入 AI 的定义中去,当然这些还期待着你的进一步探索和思考~

|

||||

|

||||

## 特别致谢

|

||||

|

||||

# 特别致谢

|

||||

非常荣幸能在本章中得到 IIPL 智能信息处理实验室 [http://iipl.net.cn](http://iipl.net.cn) 的宝贵贡献,衷心感谢他们的无私支持与帮助!

|

||||

|

||||

非常荣幸能在本章中得到 IIPL智能信息处理实验室 http://iipl.net.cn 的宝贵贡献,衷心感谢他们的无私支持与帮助!

|

||||

希望加入 IIPL?欢迎移步[SRT 社团介绍](SRT.md)~

|

||||

|

||||

@@ -1,6 +1,6 @@

|

||||

# 机器学习(AI)快速入门(quick start)

|

||||

|

||||

本章内容需要你掌握一定的 python 基础知识。

|

||||

::: warning 😇 本章内容需要你掌握一定的 python 基础知识。

|

||||

|

||||

如果你想要快速了解机器学习,并且动手尝试去实践他,你可以先阅览本部分内容。

|

||||

|

||||

@@ -11,8 +11,9 @@

|

||||

当然我需要承认一点,为了让大家都可以看懂,我做了很多抽象,具有了很多例子,某些内容不太准确,这是必然的,最为准确的往往是课本上精确到少一个字都不行的概念,这是难以理解的。

|

||||

|

||||

本篇内容只适合新手理解使用,所以不免会损失一些精度。

|

||||

:::

|

||||

|

||||

# 什么是机器学习

|

||||

## 什么是机器学习

|

||||

|

||||

这个概念其实不需要那么多杂七杂八的概念去解释。

|

||||

|

||||

@@ -22,17 +23,17 @@

|

||||

|

||||

然后你给了他更多信息,比如说国家给出了某些条例,他分析这个条例一出,房价就会降低,他给你了个新的数据。

|

||||

|

||||

因此我们得出一个结论:机器学习 = 泛型算法。

|

||||

因此我们得出一个结论:机器学习 = 泛型算法。

|

||||

|

||||

甚至深度学习,也只是机器学习的一部分,不过使用了更多技巧和方法,增大了计算能力罢了。

|

||||

|

||||

|

||||

|

||||

|

||||

# 两种机器学习算法

|

||||

## 两种机器学习算法

|

||||

|

||||

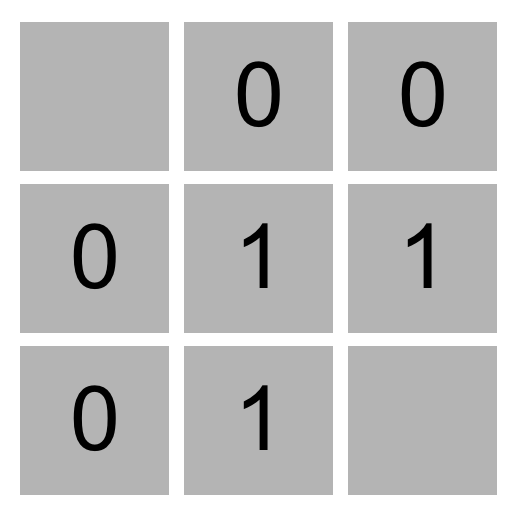

你可以把机器学习算法分为两大类:监督式学习(supervised Learning)和非监督式学习(unsupervised Learning)。要区分两者很简单,但也非常重要。

|

||||

|

||||

## 监督式学习

|

||||

### 监督式学习

|

||||

|

||||

你是卖方的,你公司很大,因此你雇了一批新员工来帮忙。

|

||||

|

||||

@@ -42,15 +43,15 @@

|

||||

|

||||

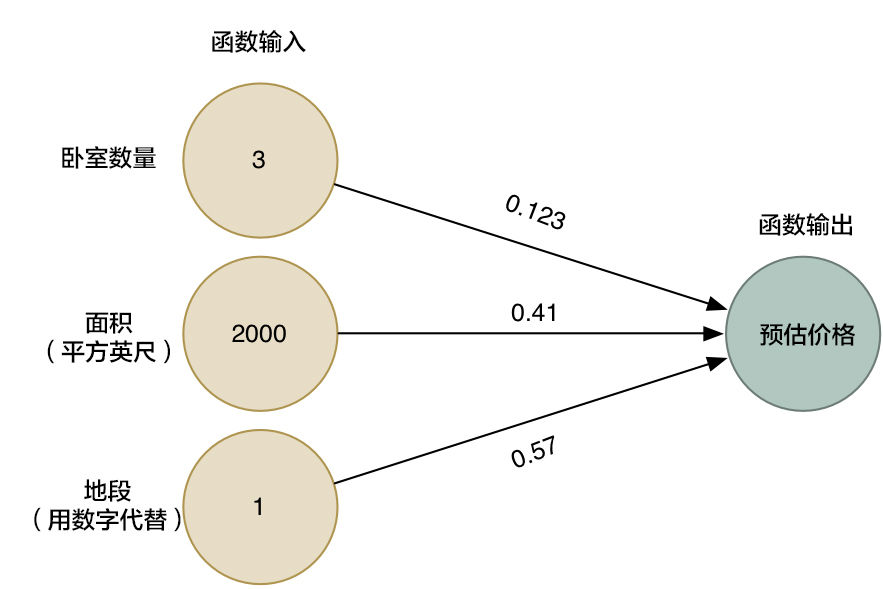

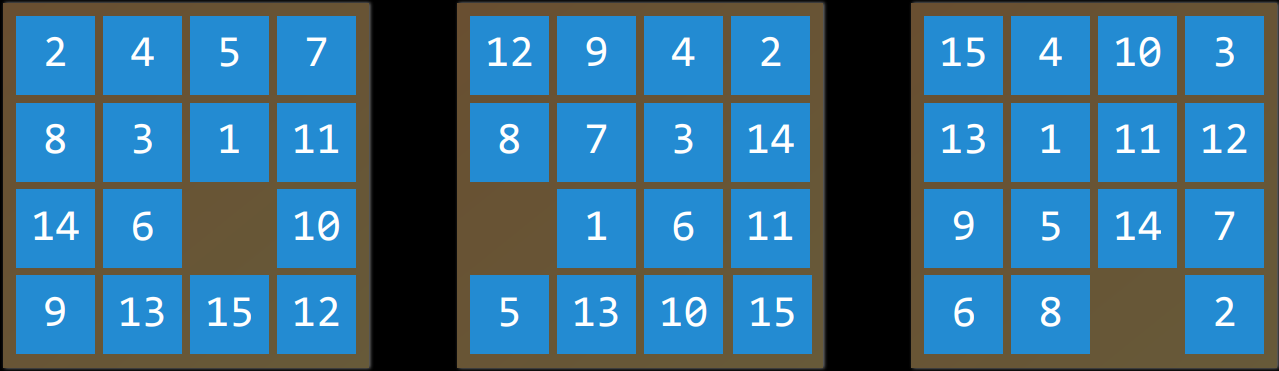

近三个月来,每当你的城市里有人卖了房子,你都记录了下面的细节——卧室数量、房屋大小、地段等等。但最重要的是,你写下了最终的成交价:

|

||||

|

||||

|

||||

|

||||

|

||||

然后你让新人根据着你的成交价来估计新的数量

|

||||

|

||||

|

||||

|

||||

|

||||

这就是监督学习,你有一个参照物可以帮你决策。

|

||||

|

||||

## 无监督学习

|

||||

### 无监督学习

|

||||

|

||||

没有答案怎么办?

|

||||

|

||||

@@ -66,7 +67,7 @@

|

||||

|

||||

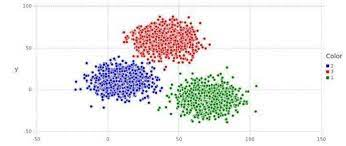

这其实就是一种经典的聚类算法

|

||||

|

||||

|

||||

|

||||

|

||||

可以把特征不一样的数据分开,有非常多的操作,你感兴趣可以选择性的去了解一下。

|

||||

|

||||

@@ -78,29 +79,27 @@

|

||||

|

||||

但是「机器在少量样本数据的基础上找出一个公式来解决特定的问题」不是个好名字。所以最后我们用「机器学习」取而代之。而深度学习,则是机器在数据的基础上通过很深的网络(很多的公式)找一个及解决方案来解决问题。

|

||||

|

||||

# 看看 Code

|

||||

## 看看 Code

|

||||

|

||||

如果你完全不懂机器学习知识,你可能会用一堆 if else 条件判断语句来判断比如说房价

|

||||

|

||||

```python

|

||||

def estimate_house_sales_price(num_of_bedrooms, sqft, neighborhood):

|

||||

price = 0 # In my area, the average house costs $200 per sqft

|

||||

price_per_sqft = 200

|

||||

if neighborhood == "hipsterton":

|

||||

price = 0 # In my area, the average house costs $200 per sqft

|

||||

price_per_sqft = 200 i f neighborhood == "hipsterton":

|

||||

# but some areas cost a bit more

|

||||

price_per_sqft = 400

|

||||

elif neighborhood == "skid row":

|

||||

price_per_sqft = 400 elif neighborhood == "skid row":

|

||||

# and some areas cost less

|

||||

price_per_sqft = 100 # start with a base price estimate based on how big the place is

|

||||

price = price_per_sqft * sqft # now adjust our estimate based on the number of bedrooms

|

||||

if num_of_bedrooms == 0:

|

||||

# Studio apartments are cheap

|

||||

price = price - 20000

|

||||

else:

|

||||

price_per_sqft = 100 # start with a base price estimate based on how big the place is

|

||||

price = price_per_sqft * sqft # now adjust our estimate based on the number of bedrooms

|

||||

if num_of_bedrooms == 0:

|

||||

# Studio apartments are cheap

|

||||

price = price — 20000

|

||||

else:

|

||||

# places with more bedrooms are usually

|

||||

# more valuable

|

||||

price = price + (num_of_bedrooms * 1000)

|

||||

return price

|

||||

price = price + (num_of_bedrooms * 1000)

|

||||

return price

|

||||

```

|

||||

|

||||

假如你像这样瞎忙几个小时,最后也许会得到一些像模像样的东西。但是永远感觉差点东西。

|

||||

@@ -119,7 +118,7 @@ def estimate_house_sales_price(num_of_bedrooms, sqft, neighborhood):

|

||||

|

||||

如果你可以找到这么一个公式:

|

||||

|

||||

Y(房价)=W(参数)*X1(卧室数量)+W*X2(面积)+W*X3(地段)

|

||||

Y(房价)=W(参数) \* X1(卧室数量) + W \*X2(面积) + W \* X3(地段)

|

||||

|

||||

你是不是会舒服很多,可以把他想象成,你要做菜,然后那些参数就是佐料的配比

|

||||

|

||||

@@ -139,7 +138,7 @@ def estimate_house_sales_price(num_of_bedrooms, sqft, neighborhood):

|

||||

|

||||

第二步把每个数值都带入进行运算。

|

||||

|

||||

|

||||

|

||||

|

||||

比如说,如果第一套房产实际成交价为 25 万美元,你的函数估价为 17.8 万美元,这一套房产你就差了 7.2 万。

|

||||

|

||||

@@ -151,7 +150,7 @@ def estimate_house_sales_price(num_of_bedrooms, sqft, neighborhood):

|

||||

|

||||

第三步:

|

||||

|

||||

通过尝试所有可能的权重值组合,不断重复第二步。哪一个权重组合的代价最接近于 0,你就使用哪个。当你找到了合适的权重值,你就解决了问题!

|

||||

通过尝试所有可能的权重值组合,不断重复第二步。哪一个权重组合的代价最接近于 0,你就使用哪个。当你找到了合适的权重值,你就解决了问题!

|

||||

|

||||

兴奋的时刻到了!

|

||||

|

||||

@@ -168,21 +167,21 @@ def estimate_house_sales_price(num_of_bedrooms, sqft, neighborhood):

|

||||

|

||||

为了避免这种情况,数学家们找到了很多种[聪明的办法](https://link.zhihu.com/?target=http%3A//en.wikipedia.org/wiki/Gradient_descent)来快速找到优秀的权重值。下面是一种:

|

||||

|

||||

|

||||

|

||||

|

||||

这就是被称为 loss 函数的东西。

|

||||

|

||||

这是个专业属于,你可以选择性忽略他,我们将它改写一下

|

||||

|

||||

|

||||

|

||||

|

||||

<em>θ 表示当前的权重值。 J(θ) 表示「当前权重的代价」。</em>

|

||||

*θ 表示当前的权重值。J(θ) 表示「当前权重的代价」。*

|

||||

|

||||

这个等式表示,在当前权重值下,我们估价程序的偏离程度。

|

||||

|

||||

如果我们为这个等式中所有卧室数和面积的可能权重值作图的话,我们会得到类似下图的图表:

|

||||

|

||||

|

||||

|

||||

|

||||

因此,我们需要做的只是调整我们的权重,使得我们在图上朝着最低点「走下坡路」。如果我们不断微调权重,一直向最低点移动,那么我们最终不用尝试太多权重就可以到达那里。

|

||||

|

||||

@@ -194,7 +193,7 @@ def estimate_house_sales_price(num_of_bedrooms, sqft, neighborhood):

|

||||

|

||||

当你使用一个机器学习算法库来解决实际问题时,这些都已经为你准备好了。但清楚背后的原理依然是有用的。

|

||||

|

||||

|

||||

|

||||

|

||||

枚举法

|

||||

|

||||

@@ -204,13 +203,13 @@ def estimate_house_sales_price(num_of_bedrooms, sqft, neighborhood):

|

||||

|

||||

不过幸运的是,有很多办法来处理这种情况。有许多机器学习算法可以处理非线性数据。除此之外,灵活使用线性回归也能拟合更复杂的线条。在所有的情况下,寻找最优权重这一基本思路依然适用。

|

||||

|

||||

<strong>如果你还是无法理解,你可以将 cost 类比为你出错误的程度,而数学科学家找到各种方法来降低这种程度,当程度降到最低时,我们就可以知道我们要求的数值了</strong>

|

||||

**如果你还是无法理解,你可以将 cost 类比为你出错误的程度,而数学科学家找到各种方法来降低这种程度,当程度降到最低时,我们就可以知道我们要求的数值了**

|

||||

|

||||

另外,我忽略了过拟合(overfitting)的概念。得到一组能完美预测原始数据集中房价的权重组很简单,但用这组权重组来预测原始数据集之外的任何新房屋其实都不怎么准确。这也是有许多解决办法的(如[正则化](https://link.zhihu.com/?target=http%3A//en.wikipedia.org/wiki/Regularization_%2528mathematics%2529%23Regularization_in_statistics_and_machine_learning)以及使用[交叉验证](https://link.zhihu.com/?target=http%3A//en.wikipedia.org/wiki/Cross-validation_%2528statistics%2529)的数据集)。学习如何应对这一问题,是学习如何成功应用机器学习技术的重点之一。

|

||||

|

||||

换言之,尽管基本概念非常简单,要通过机器学习得到有用的结果还是需要一些技巧和经验的。但是,这是每个开发者都能学会的技巧。

|

||||

|

||||

# 更为智能的预测

|

||||

## 更为智能的预测

|

||||

|

||||

我们通过上一次的函数假设已经得到了一些值。

|

||||

|

||||

@@ -225,25 +224,25 @@ def estimate_house_sales_price(num_of_bedrooms, sqft, neighborhood):

|

||||

|

||||

我们换一个好看的形式给他展示

|

||||

|

||||

|

||||

|

||||

|

||||

<em>箭头头表示了函数中的权重。</em>

|

||||

*箭头头表示了函数中的权重。*

|

||||

|

||||

然而,这个算法仅仅能用于处理一些简单的问题,就是那些输入和输出有着线性关系的问题。但如果真实价格和决定因素的关系并不是如此简单,那我们该怎么办? 比如说,地段对于大户型和小户型的房屋有很大影响,然而对中等户型的房屋并没有太大影响。那我们该怎么在我们的模型中收集这种复杂的信息呢?

|

||||

然而,这个算法仅仅能用于处理一些简单的问题,就是那些输入和输出有着线性关系的问题。但如果真实价格和决定因素的关系并不是如此简单,那我们该怎么办?比如说,地段对于大户型和小户型的房屋有很大影响,然而对中等户型的房屋并没有太大影响。那我们该怎么在我们的模型中收集这种复杂的信息呢?

|

||||

|

||||

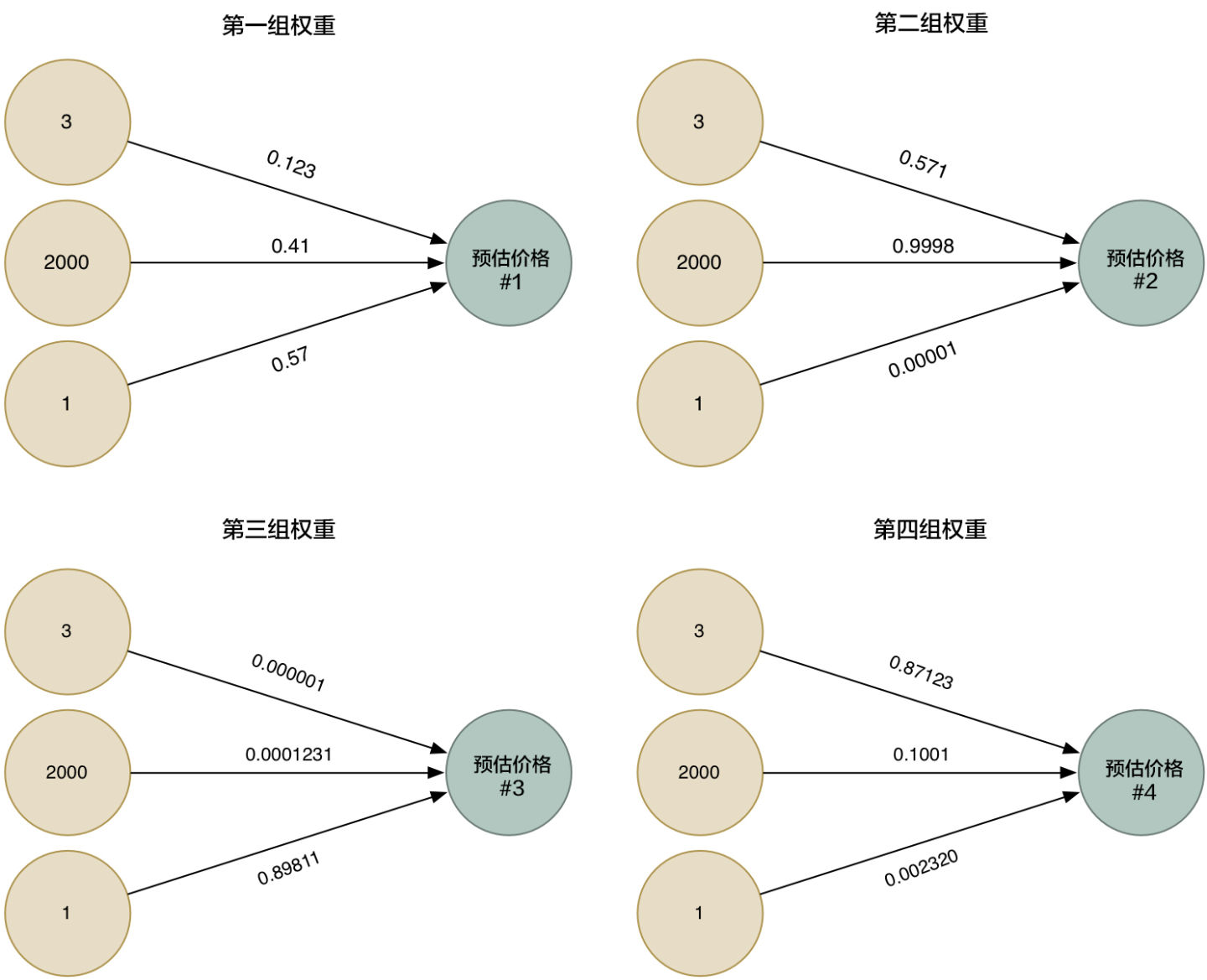

所以为了更加的智能化,我们可以利用不同的权重来多次运行这个算法,收集各种不同情况下的估价。

|

||||

|

||||

|

||||

|

||||

|

||||

然后我们把四种整合到一起,就得到一个超级答案

|

||||

|

||||

|

||||

|

||||

|

||||

这样我们相当于得到了更为准确的答案

|

||||

|

||||

# 神经网络是什么

|

||||

## 神经网络是什么

|

||||

|

||||

|

||||

|

||||

|

||||

我们把四个超级网络的结合图整体画出来,其实这就是个超级简单的神经网络,虽然我们省略了很多的内容,但是他仍然有了一定的拟合能力

|

||||

|

||||

@@ -272,7 +271,7 @@ class LinearModel(torch.nn.Module):

|

||||

y_pred=self.linear(x)

|

||||

return y_pred

|

||||

'''

|

||||

线性模型所必须的前馈传播,即wx+b

|

||||

线性模型所必须的前馈传播,即 wx+b

|

||||

'''

|

||||

|

||||

model=LinearModel()

|

||||

@@ -299,36 +298,38 @@ y_test=model(x_test)

|

||||

print('y_pred=',y_test.data)

|

||||

```

|

||||

|

||||

# 由浅入深(不会涉及代码)

|

||||

## 由浅入深(不会涉及代码)

|

||||

|

||||

# 为什么不教我写代码?

|

||||

::: warning 😇 为什么不教我写代码?

|

||||

|

||||

因为你可能看这些基础知识感觉很轻松毫无压力,但是倘若附上很多代码,会一瞬间拉高这里的难度,虽然仅仅只是调包。

|

||||

|

||||

但是我还是会在上面贴上一点代码,但不会有很详细的讲解,因为很多都是调包,没什么好说的,如果你完全零基础,忽略这部分内容即可

|

||||

|

||||

:::

|

||||

|

||||

我们尝试做一个神奇的工作,那就是用神经网络来识别一下手写数字,听上去非常不可思议,但是我要提前说的一点是,图像也不过是数据的组合,每一张图片有不同程度的像素值,如果我们把每一个像素值都当成神经网络的输入值,然后经过一个黑盒,让他识别出一个他认为可能的数字,然后进行纠正即可。

|

||||

|

||||

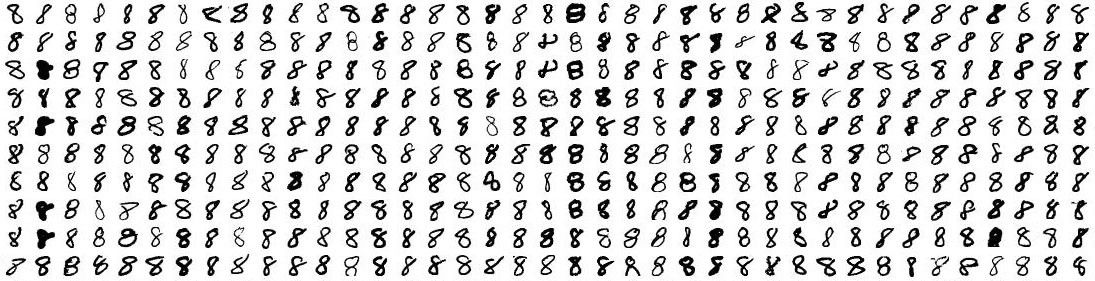

机器学习只有在你拥有数据(最好是大量数据)的情况下,才能有效。所以,我们需要有大量的手写「8」来开始我们的尝试。幸运的是,恰好有研究人员建立了 [MNIST 手写数字数据库](https://link.zhihu.com/?target=http%3A//yann.lecun.com/exdb/mnist/),它能助我们一臂之力。MNIST 提供了 60,000 张手写数字的图片,每张图片分辨率为 18×18。即有这么多的数据。

|

||||

|

||||

```python

|

||||

(X_train, y_train), (X_test, y_test) = mnist.load_data()

|

||||

#这段是导入minist的方法,但是你看不到,如果你想看到的话需要其他操作

|

||||

#这段是导入 minist 的方法,但是你看不到,如果你想看到的话需要其他操作

|

||||

```

|

||||

|

||||

我们试着只识别一个数字 8

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

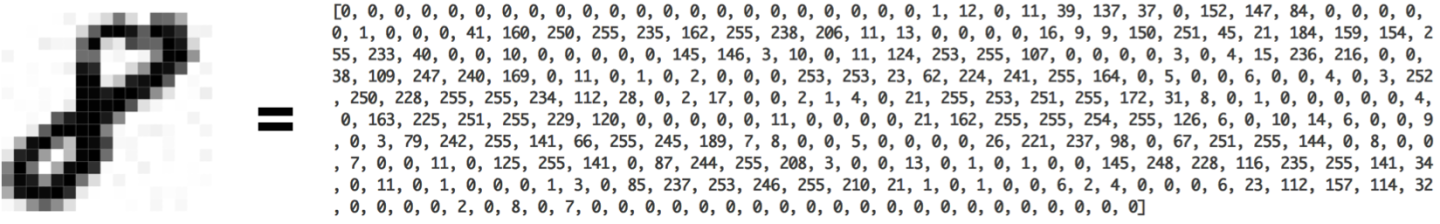

我们把一幅 18×18 像素的图片当成一串含有 324 个数字的数组,就可以把它输入到我们的神经网络里面了:

|

||||

|

||||

|

||||

|

||||

|

||||

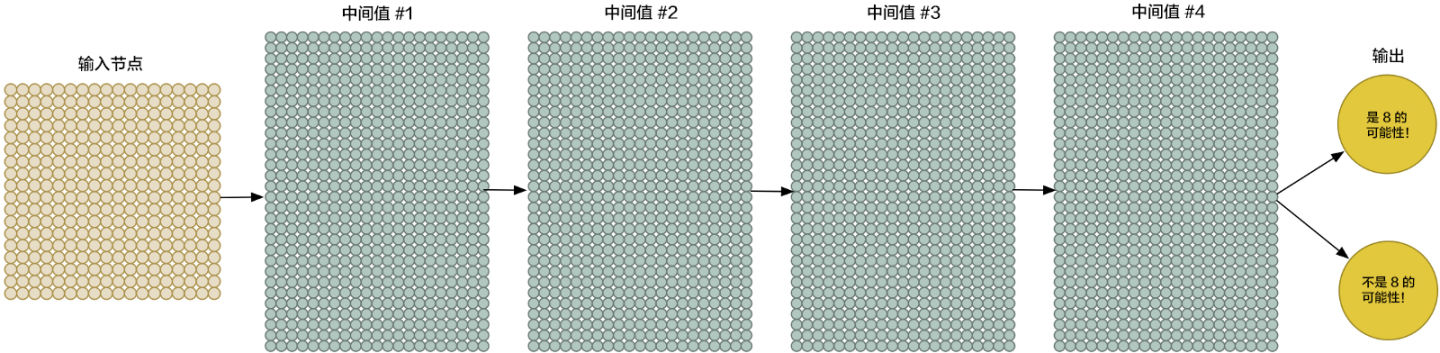

为了更好地操控我们的输入数据,我们把神经网络的输入节点扩大到 324 个:

|

||||

|

||||

|

||||

|

||||

|

||||

请注意,我们的神经网络现在有了两个输出(而不仅仅是一个房子的价格)。第一个输出会预测图片是「8」的概率,而第二个则输出不是「8」的概率。概括地说,我们就可以依靠多种不同的输出,利用神经网络把要识别的物品进行分组。

|

||||

|

||||

@@ -345,17 +346,17 @@ model.add(Activation('relu'))# 激活函数,你可以理解为加上这个东

|

||||

|

||||

现在唯一要做的就是用各种「8」和非「8」的图片来训练我们的神经网络了。当我们喂给神经网络一个「8」的时候,我们会告诉它是「8」的概率是 100% ,而不是「8」的概率是 0%,反之亦然。

|

||||

|

||||

# 仅此而已吗

|

||||

## 仅此而已吗

|

||||

|

||||

当数字并不是正好在图片中央的时候,我们的识别器就完全不工作了。一点点的位移我们的识别器就掀桌子不干了

|

||||

|

||||

|

||||

|

||||

|

||||

这是因为我们的网络只学习到了正中央的「8」。它并不知道那些偏离中心的「8」长什么样子。它仅仅知道中间是「8」的图片规律。

|

||||

|

||||

在真实世界中,这种识别器好像并没什么卵用。真实世界的问题永远不会如此轻松简单。所以,我们需要知道,当「8」不在图片正中时,怎么才能让我们的神经网络识别它。

|

||||

|

||||

## 暴力方法:更多的数据和更深的网络

|

||||

### 暴力方法:更多的数据和更深的网络

|

||||

|

||||

他不能识别靠左靠右的数据?我们都给他!给他任何位置的图片!

|

||||

|

||||

@@ -365,19 +366,19 @@ model.add(Activation('relu'))# 激活函数,你可以理解为加上这个东

|

||||

|

||||

当然,你同时也需要更强的拟合能力和更深的网络。

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

一层一层堆叠起来,这种方法很早就出现了。

|

||||

|

||||

## 更好的方法?

|

||||

### 更好的方法?

|

||||

|

||||

你可以通过卷积神经网络进行进一步的处理

|

||||

|

||||

作为人类,你能够直观地感知到图片中存在某种层级(hierarchy)或者是概念结构(conceptual structure)。比如说,你在看

|

||||

|

||||

|

||||

|

||||

|

||||

你会快速的辨认出一匹马,一个人。

|

||||

|

||||

@@ -387,25 +388,25 @@ model.add(Activation('relu'))# 激活函数,你可以理解为加上这个东

|

||||

|

||||

有人对此做过研究,人的眼睛可能会逐步判断一个物体的信息,比如说你看到一张图片,你会先看颜色,然后看纹理然后再看整体,那么我们需要一种操作来模拟这个过程,我们管这种操作叫卷积操作。

|

||||

|

||||

|

||||

|

||||

|

||||

## 卷积是如何工作的

|

||||

### 卷积是如何工作的

|

||||

|

||||

之前我们提到过,我们可以把一整张图片当做一串数字输入到神经网络里面。不同的是,这次我们会利用<strong>平移不变性</strong>的概念来把这件事做得更智能。

|

||||

之前我们提到过,我们可以把一整张图片当做一串数字输入到神经网络里面。不同的是,这次我们会利用**平移不变性**的概念来把这件事做得更智能。

|

||||

|

||||

当然也有最新研究说卷积不具备平移不变性,但是我这里使用这个概念是为了大伙更好的理解,举个例子:你将 8 无论放在左上角还是左下角都改变不了他是 8 的事实

|

||||

|

||||

|

||||

|

||||

|

||||

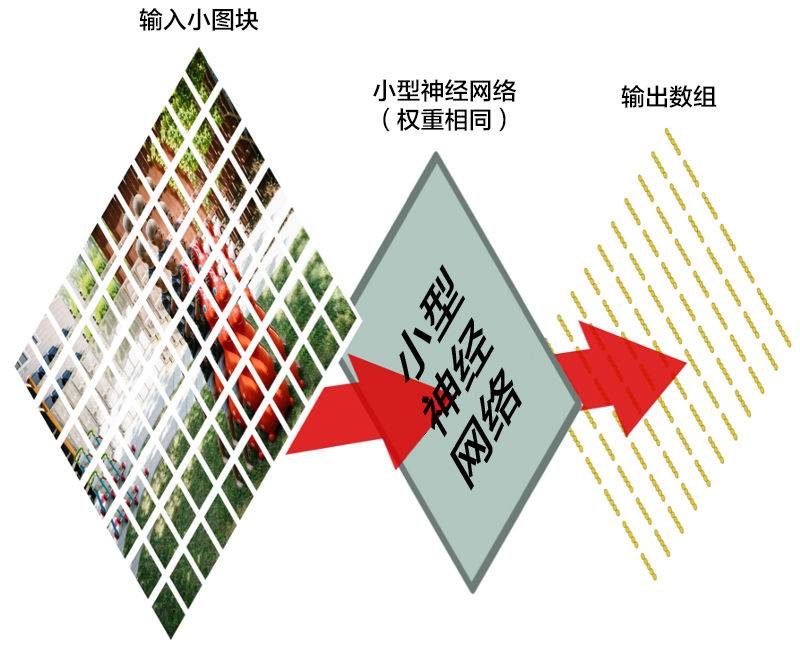

我们将一张图像分成这么多个小块,然后输入神经网络中的是一个小块。<em>每次判断一张小图块。</em>

|

||||

我们将一张图像分成这么多个小块,然后输入神经网络中的是一个小块。*每次判断一张小图块。*

|

||||

|

||||

然而,有一个非常重要的不同:对于每个小图块,我们会使用同样的神经网络权重。换一句话来说,我们平等对待每一个小图块。如果哪个小图块有任何异常出现,我们就认为这个图块是「异常」

|

||||

|

||||

|

||||

|

||||

|

||||

换一句话来说,我们从一整张图片开始,最后得到一个稍小一点的数组,里面存储着我们图片中的哪一部分有异常。

|

||||

|

||||

## 池化层

|

||||

### 池化层

|

||||

|

||||

图像可能特别大。比如说 1024*1024 再来个颜色 RGB

|

||||

|

||||

@@ -413,7 +414,7 @@ model.add(Activation('relu'))# 激活函数,你可以理解为加上这个东

|

||||

|

||||

让我们先来看每个 2×2 的方阵数组,并且留下最大的数:

|

||||

|

||||

|

||||

|

||||

|

||||

每一波我们只保留一个数,这样就大大减少了图片的计算量了。

|

||||

|

||||

@@ -429,13 +430,13 @@ model.add(Activation('relu'))# 激活函数,你可以理解为加上这个东

|

||||

|

||||

我们也要感谢显卡,这项技术早就出现了但是一直算不了,有了显卡让这件事成为了可能。

|

||||

|

||||

## 作出预测

|

||||

### 作出预测

|

||||

|

||||

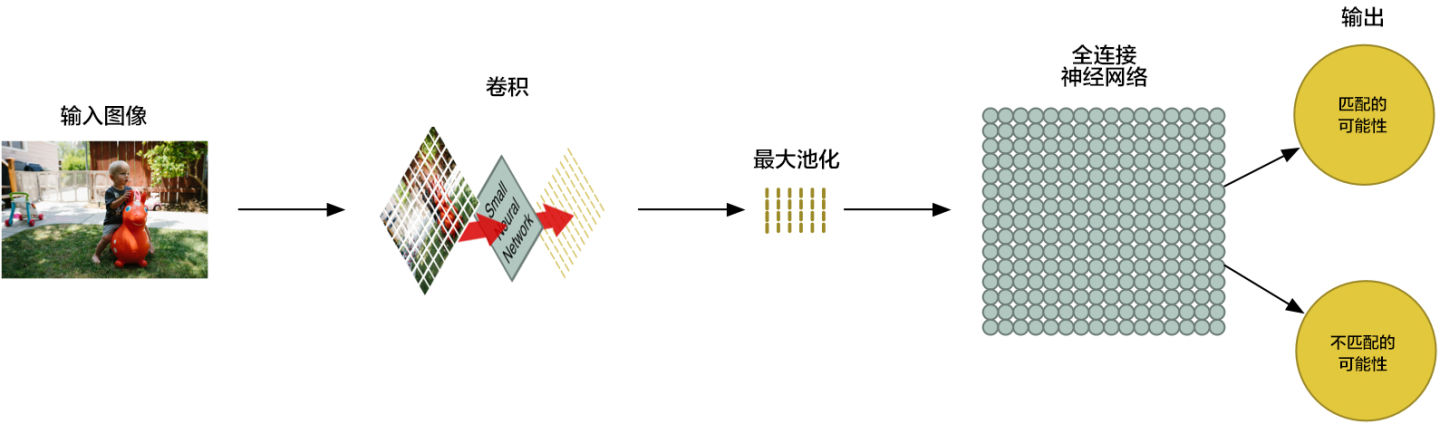

到现在为止,我们已经把一个很大的图片缩减到了一个相对较小的数组。

|

||||

|

||||

你猜怎么着?数组就是一串数字而已,所以我们我们可以把这个数组输入到另外一个神经网络里面去。最后的这个神经网络会决定这个图片是否匹配。为了区分它和卷积的不同,我们把它称作「全连接」网络

|

||||

|

||||

|

||||

|

||||

|

||||

我们的图片处理管道是一系列的步骤:卷积、最大池化,还有最后的「全连接」网络。

|

||||

|

||||

@@ -445,10 +446,10 @@ model.add(Activation('relu'))# 激活函数,你可以理解为加上这个东

|

||||

|

||||

比如说,第一个卷积的步骤可能就是尝试去识别尖锐的东西,而第二个卷积步骤则是通过找到的尖锐物体来找鸟类的喙,最后一步是通过鸟喙来识别整只鸟,以此类推。

|

||||

|

||||

# 结语

|

||||

## 结语

|

||||

|

||||

这篇文章仅仅只是粗略的讲述了一些机器学习的一些基本操作,如果你要更深一步学习的话你可能还需要更多的探索。

|

||||

|

||||

# 参考资料

|

||||

## 参考资料

|

||||

|

||||

[machine-learning-for-software-engineers/README-zh-CN.md at master · ZuzooVn/machine-learning-for-sof](https://github.com/ZuzooVn/machine-learning-for-software-engineers/blob/master/README-zh-CN.md#%E6%9C%BA%E5%99%A8%E5%AD%A6%E4%B9%A0%E6%A6%82%E8%AE%BA)

|

||||

|

||||

@@ -1,16 +1,15 @@

|

||||

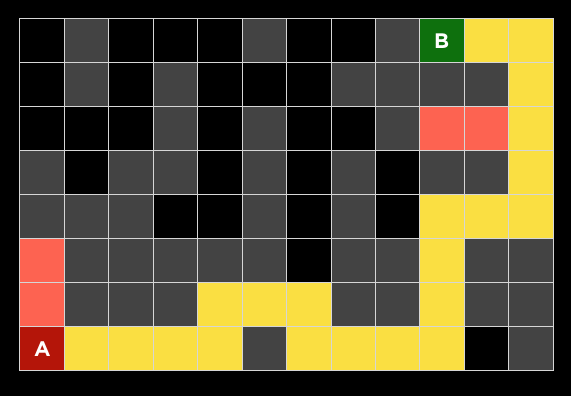

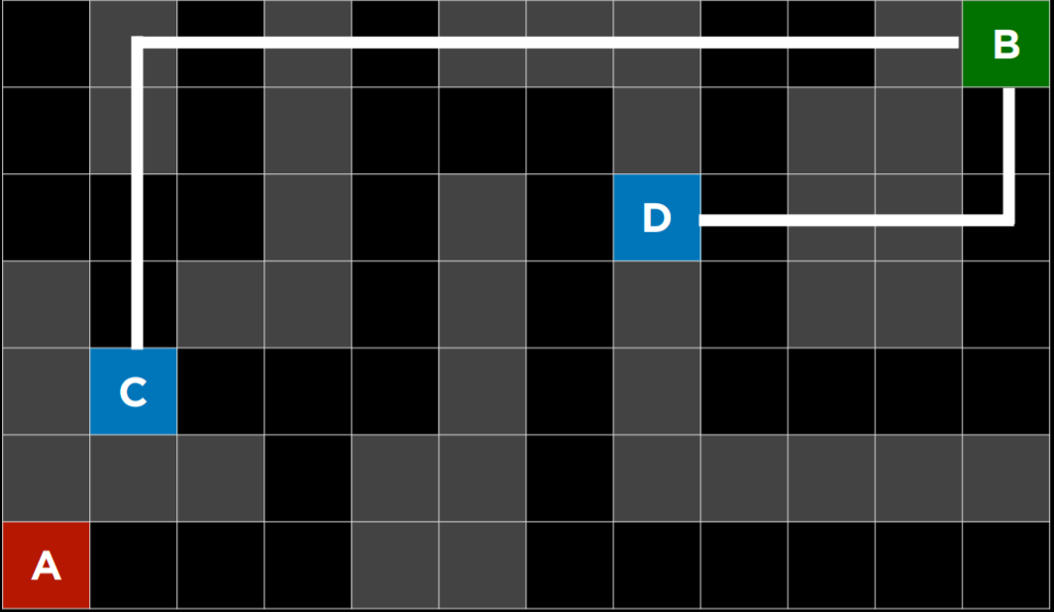

# 程序示例——maze 迷宫解搜索

|

||||

|

||||

::: warning 😋

|

||||

阅读程序中涉及搜索算法的部分,然后运行程序,享受机器自动帮你寻找路径的快乐!

|

||||

完成习题

|

||||

:::

|

||||

|

||||

::: tip 📥

|

||||

本节附件下载 <Download url="https://pic-hdu-cs-wiki-1307923872.cos.ap-shanghai.myqcloud.com/code/1-Lecture.zip"/>

|

||||

本节附件下载 <Download url="https://cdn.xyxsw.site/code/1-Lecture.zip"/>

|

||||

:::

|

||||

|

||||

/4.人工智能/code/MAZE.zip

|

||||

|

||||

# Node

|

||||

## Node

|

||||

|

||||

```python

|

||||

# 节点类 Node

|

||||

@@ -21,7 +20,7 @@ class Node:

|

||||

self.action = action # 存储采取的行动

|

||||

```

|

||||

|

||||

## 节点复习:

|

||||

## 节点复习

|

||||

|

||||

- 节点是一种包含以下数据的数据结构:

|

||||

- 状态——state

|

||||

@@ -29,7 +28,7 @@ class Node:

|

||||

- 应用于父级状态以获取当前节点的操作——action

|

||||

- 从初始状态到该节点的路径成本——path cost

|

||||

|

||||

# 堆栈边域——DFS

|

||||

## 堆栈边域——DFS

|

||||

|

||||

```python

|

||||

class StackFrontier: # 堆栈边域

|

||||

@@ -50,11 +49,11 @@ class StackFrontier: # 堆栈边域

|

||||

return node

|

||||

```

|

||||

|

||||

## 深度优先搜索复习:

|

||||

## 深度优先搜索复习

|

||||

|

||||

- 深度优先搜索算法在尝试另一个方向之前耗尽每个方向。在这些情况下,边域作为堆栈数据结构进行管理。这里需要记住的流行语是“后进先出”。在将节点添加到边域后,第一个要删除和考虑的节点是最后一个要添加的节点。这导致了一种搜索算法,该算法在第一个方向上尽可能深入,直到尽头,同时将所有其他方向留到后面。“不撞南墙不回头”

|

||||

深度优先搜索算法在尝试另一个方向之前耗尽每个方向。在这些情况下,边域作为堆栈数据结构进行管理。这里需要记住的流行语是“后进先出”。在将节点添加到边域后,第一个要删除和考虑的节点是最后一个要添加的节点。这导致了一种搜索算法,该算法在第一个方向上尽可能深入,直到尽头,同时将所有其他方向留到后面。“不撞南墙不回头”

|

||||

|

||||

# 队列边域——BFS

|

||||

## 队列边域——BFS

|

||||

|

||||

```python

|

||||

class QueueFrontier(StackFrontier): # 队列边域

|

||||

@@ -67,11 +66,11 @@ class QueueFrontier(StackFrontier): # 队列边域

|

||||

return node

|

||||

```

|

||||

|

||||

## 广度优先搜索复习:

|

||||

## 广度优先搜索复习

|

||||

|

||||

- 广度优先搜索算法将同时遵循多个方向,在每个可能的方向上迈出一步,然后在每个方向上迈出第二步。在这种情况下,边域作为队列数据结构进行管理。这里需要记住的流行语是“先进先出”。在这种情况下,所有新节点都会排成一行,并根据先添加的节点来考虑节点(先到先得!)。这导致搜索算法在任何一个方向上迈出第二步之前,在每个可能的方向上迈出一步。

|

||||

广度优先搜索算法将同时遵循多个方向,在每个可能的方向上迈出一步,然后在每个方向上迈出第二步。在这种情况下,边域作为队列数据结构进行管理。这里需要记住的流行语是“先进先出”。在这种情况下,所有新节点都会排成一行,并根据先添加的节点来考虑节点(先到先得!)。这导致搜索算法在任何一个方向上迈出第二步之前,在每个可能的方向上迈出一步。

|

||||

|

||||

# 迷宫解——Maze_solution

|

||||

## 迷宫解——Maze_solution

|

||||

|

||||

```python

|

||||

class Maze:

|

||||

@@ -111,7 +110,7 @@ class Maze:

|

||||

# 打印结果

|

||||

def print(self):

|

||||

...

|

||||

# 寻找邻结点,返回元组(动作,坐标(x,y))

|

||||