Update

many chore

This commit is contained in:

@@ -6,16 +6,16 @@ author:廖总

|

||||

|

||||

先声夺人:AI 时代最大的陷阱,就是盲目考察 AI 能为我们做什么,而不去考虑我们能为 AI 提供什么

|

||||

|

||||

### <em>免责声明</em>

|

||||

## <em>免责声明</em>

|

||||

|

||||

本文纯文本量达 16k(我也不知道字数统计的 28k 是怎么来的),在这 游离散乱的主线 和 支离破碎的文字 中挣扎,可能浪费您生命中宝贵的十数分钟。

|

||||

|

||||

但如果您坚持尝试阅读,可能看到如下内容(假设没在其中绕晕的话 ):

|

||||

但如果您坚持尝试阅读,可能看到如下内容(假设没在其中绕晕的话):

|

||||

|

||||

- 对大语言模型本质 以及 AI 时代人们生产创作本位 的讨论

|

||||

- 对大语言模型 上下文学习(In-Context Learning,ICL)和 思维链(Chain of Thought,COT)能力的几种通识性认知

|

||||

- 围绕 Prompt Decomposition 对使用大语言模型构建复杂应用的基础讨论

|

||||

- 对当前热门大模型 Agent 化框架(如 Generative Agents (即斯坦福 25 人小镇)、AutoGPT)其本质的讨论

|

||||

- 对当前热门大模型 Agent 化框架(如 Generative Agents(即斯坦福 25 人小镇)、AutoGPT)其本质的讨论

|

||||

- 对使用大语言模型构建智能系统(基于全局工作空间意识理论)的初步讨论

|

||||

- 对使用大语言模型构建符合当今生产需求的智能系统的方法论讨论

|

||||

|

||||

@@ -31,7 +31,7 @@ author:廖总

|

||||

- LLMs 能力考察:讨论了大语言模型涌现的一系列基本能力,并讨论基于这些基本能力和工程化,大模型能做到哪一步

|

||||

- Decomp 方法论:将大语言模型微分化使用的方法论,以此展开对大语言模型的新认知

|

||||

- AI 作为智能系统:结合 Generative Agents、AutoGPT 两项工作讨论大语言模型本身的局限性,围绕人类认知模型的启发,讨论通过构建复杂系统使得 LLMs Agent 化的可能性

|

||||

- 予智能以信息:讨论基于 LLMs 构建能够充分帮助我们提升生产力的 AI 剩余的一切痛点。借以回到主题 —— 在 AI 时代,我们要打造什么样的生产和信息管理新范式 (有一说,还是空口无凭)

|

||||

- 予智能以信息:讨论基于 LLMs 构建能够充分帮助我们提升生产力的 AI 剩余的一切痛点。借以回到主题 —— 在 AI 时代,我们要打造什么样的生产和信息管理新范式(有一说,还是空口无凭)

|

||||

|

||||

总体而言,本文包括对 LLM 领域近一个月的最新几项工作(TaskMatrix、HuggingGPT、Generative Agents、AutoGPT)的讨论,并基于此考察一个真正可用的 AI 会以什么样的形态出现在我们面前。

|

||||

|

||||

@@ -43,7 +43,7 @@ author:廖总

|

||||

|

||||

仅作展望。

|

||||

|

||||

# 引言

|

||||

## 引言

|

||||

|

||||

在开启正式讨论之前,我们希望从两个角度分别对 AI 进行讨论,从而夹逼出我们 从 AI 到 智能系统 的主题

|

||||

|

||||

@@ -56,7 +56,7 @@ author:廖总

|

||||

|

||||

以前只知前边两句,现在才知精髓全在后者

|

||||

|

||||

## 形而下者器:LLMs + DB 的使用样例

|

||||

### 形而下者器:LLMs + DB 的使用样例

|

||||

|

||||

(为了不让话题一开场就显得那么无聊,我们先来谈点有意思的例子)

|

||||

|

||||

@@ -77,7 +77,7 @@ author:廖总

|

||||

|

||||

(后面会给出更多关联的讨论,这里就先不赘叙了)

|

||||

|

||||

## 形而上者道:对 LLM 既有智能能力及其局限性的讨论

|

||||

### 形而上者道:对 LLM 既有智能能力及其局限性的讨论

|

||||

|

||||

这一节中,想讨论一下人工智能与人类智能的碰撞()

|

||||

|

||||

@@ -99,7 +99,7 @@ ChatGPT Plugins 在两篇论文两个角度的基础上,对 LLMs 的能力的

|

||||

- 为 AI 提供接口,为 AI 拓展能力

|

||||

- 建模自身问题,促进有效生成

|

||||

|

||||

### 从人工智能到人类智能

|

||||

#### 从人工智能到人类智能

|

||||

|

||||

在上面的论断中,我们看似已经能将绝大多数智能能力出让予 AI 了,但我还想从另一角度对 AI 与人类的能力进行展开讨论:

|

||||

|

||||

@@ -109,7 +109,7 @@ ChatGPT Plugins 在两篇论文两个角度的基础上,对 LLMs 的能力的

|

||||

- “人工”智能:辅佐 AI 实现的智能

|

||||

- 人类智能:于人类独一无二的东西

|

||||

|

||||

### AI 智能的形态

|

||||

#### AI 智能的形态

|

||||

|

||||

大语言模型的原始目的是制造一个“压缩器”,设计者们希望他能有效地学习世界上所有信息,并对其进行通用的压缩。

|

||||

|

||||

@@ -120,11 +120,11 @@ ChatGPT Plugins 在两篇论文两个角度的基础上,对 LLMs 的能力的

|

||||

> “人总是要死的,苏格拉底也是人,所以苏格拉底是要死的”<br/>这是一个经典苏格拉底式的三段论,其中蕴含着人类对于演绎推理能力的智慧。<br/>假设上面的样本是 LLM 既有学习的,而这时来了一个新的样本:<br/>“人不吃饭会被饿死,我是人,所以我也是要恰饭的嘛”<br/>那么对于一个理想的智能压缩器而言,其可能发现新句与旧句之间的关联,并有效学习到了句子的表征形式及其背后的逻辑

|

||||

|

||||

$$

|

||||

S1=<(人,苏格拉底,死),三段式推理>

|

||||

S1=<(人,苏格拉底,死),三段式推理>

|

||||

$$

|

||||

|

||||

$$

|

||||

S2=<(人,我,恰饭),三段式推理>

|

||||

S2=<(人,我,恰饭),三段式推理>

|

||||

$$

|

||||

|

||||

> 而随后,压缩器会倾向于储存三段式推理这一智能结构,并在一定程度上丢弃后来的(人,我,恰饭)这一实体关系组,仅简单建模其间联系,并在生成时按需调整预测权重。

|

||||

@@ -144,7 +144,7 @@ LLM 的实质上还是通过“语言结构”对“外显人类智能”进行

|

||||

|

||||

而也正是这些固有缺陷,为人类的自我定位和进一步利用 AI 找到了立足点。

|

||||

|

||||

### 赋能 AI 实现智能

|

||||

#### 赋能 AI 实现智能

|

||||

|

||||

作为上面一点的衍生,我们可以从大体两个角度去辅助 AI 智能的实现:

|

||||

|

||||

@@ -200,13 +200,13 @@ LLM 的实质上还是通过“语言结构”对“外显人类智能”进行

|

||||

|

||||

简而言之,我希望能追随着 AI 的发展,讨论是否能构建这样一个通用的 AI 框架,并将其引入工作生产的方方面面。希望能讨论及如何对生产信息进行有效的管理,也包括如何让我们更好调用 AI,如何让 AI 满足我们的生产需要。

|

||||

|

||||

# LLMs:生成原理及能力考察

|

||||

## LLMs:生成原理及能力考察

|

||||

|

||||

相信无论是否专业,各位对 LLMs 的生成原理都有着一定的认知

|

||||

|

||||

简单来说,这就是一个单字接龙游戏,通过自回归地预测“下一个字”。在这个过程的训练中,LLMs 学习到了知识结构,乃至一系列更复杂的底层关联,成为了一种人类无法理解的智能体。

|

||||

|

||||

## In-Context Learning / Chain of Thought

|

||||

### In-Context Learning / Chain of Thought

|

||||

|

||||

经过人们对模型背后能力的不懈考察,发现了一系列亮点,其中最瞩目的还是两点:

|

||||

|

||||

@@ -233,8 +233,7 @@ COT 为输出增加关联

|

||||

|

||||

进一步的,ICL 的发现,让 LLMs 能避免过多的传统 Finetune,轻易将能力运用在当前的情景中;COT 的发现,使得通过 LLMs 解决复杂问题成为可能。此二者的组合,为 LLMs 的通用能力打下了基础。

|

||||

|

||||

|

||||

## TaskMatrix.AI

|

||||

### TaskMatrix.AI

|

||||

|

||||

微软对 [TaskMatrix.AI](https://arxiv.org/abs/2303.16434) 这一项目的研究,很大程度上展示了 LLMs 基于 ICL 和 COT 所能展现的能力

|

||||

|

||||

@@ -261,7 +260,7 @@ TaskMatrix 的生态愿景

|

||||

|

||||

(当然,硬要说的话,对 ICL 和 COT 两种能力都有一个狭义与广义之争,但这不重要,因为我喜欢广义)

|

||||

|

||||

### ICL for TaskMatrix

|

||||

#### ICL for TaskMatrix

|

||||

|

||||

> 狭义的 ICL:从输入的既有样例中学习分布和规范<br/>广义的 ICL:有效的将输入内容有效运用到输出中

|

||||

|

||||

@@ -295,13 +294,13 @@ TaskMatrix 自动围绕目标拆解任务

|

||||

|

||||

TaskMatrix 自动为任务创建 API 调用链

|

||||

|

||||

## 初步考察

|

||||

### 初步考察

|

||||

|

||||

基于上述的简单介绍,我们已经初步认识了 AI 在实际情景中的高度可用性

|

||||

|

||||

而接下来,我们继续从工程的角度揭示这种可用性的根源 —— 其源自一项通用的 Prompt 技术

|

||||

|

||||

# Prompt Decomposition:方法论

|

||||

## Prompt Decomposition:方法论

|

||||

|

||||

我们可以认为,TaskMatirx 的能力极大程度上依托于 Prompt Decomposition 的方法

|

||||

|

||||

@@ -309,7 +308,7 @@ TaskMatrix 自动为任务创建 API 调用链

|

||||

|

||||

[[2210.02406] Decomposed Prompting: A Modular Approach for Solving Complex Tasks (](https://arxiv.org/abs/2210.02406)[arxiv.org](https://arxiv.org/abs/2210.02406)[)](https://arxiv.org/abs/2210.02406)

|

||||

|

||||

## 原始 Decomp

|

||||

### 原始 Decomp

|

||||

|

||||

Decomp 的核心思想为将复杂问题通过 Prompt 技巧,将一个复杂的问题由 LLMs 自主划分为多个子任务。随后,我们通过 LLMs 完成多个任务,并将过程信息最终组合并输出理想的效果

|

||||

|

||||

@@ -327,7 +326,7 @@ Decomp 方法执行样例

|

||||

|

||||

在实际运行中,Decomp 过程由一个任务分解器,和一组程序解析器组成

|

||||

|

||||

其中分解器作为语言中枢,需要被授予如何分解复杂任务 —— 其将根据一个问题 Q 构建一个完整的提示程序 P ,这个程序包含一系列简单的子问题 Q_i,以及用于处理该子问题的专用函数 f_i(可以通过特定小型 LLM 或专用程序,也可以以更小的提示程序 P_i 形式呈现)。

|

||||

其中分解器作为语言中枢,需要被授予如何分解复杂任务 —— 其将根据一个问题 Q 构建一个完整的提示程序 P,这个程序包含一系列简单的子问题 Q_i,以及用于处理该子问题的专用函数 f_i(可以通过特定小型 LLM 或专用程序,也可以以更小的提示程序 P_i 形式呈现)。

|

||||

|

||||

模型将通过递归运行完整的提示程序,来获得理想的答案。

|

||||

|

||||

@@ -335,15 +334,15 @@ Decomp 方法执行样例

|

||||

|

||||

我们也可以认为,在每个子任务中,我们通过 Prompt 将 LLMs 的能力进行了劣化,从而让其成为一个专职的功能零件。而这种对单个 LLMs 能力迷信的削减,正延伸出了后续的发展趋势。

|

||||

|

||||

## Decomp 衍生

|

||||

### Decomp 衍生

|

||||

|

||||

Decomp 的原始功能实际上并不值得太过关注,但我们急需考虑,该方法还能用于处理些什么问题。

|

||||

|

||||

### 递归调用

|

||||

#### 递归调用

|

||||

|

||||

我们可以构建规则,让 Decomp 方法中的分解器递归调用自身,从而使得一个可能困难的问题无限细分,并最终得以解决

|

||||

|

||||

### 外部调用

|

||||

#### 外部调用

|

||||

|

||||

通过问题的分解和通过“专用函数”的执行,我们可以轻易让 LLMs 实现自身无法做到的调用 API 工作,例如主动从外部检索获取回答问题所需要的知识。

|

||||

|

||||

@@ -355,7 +354,7 @@ Decomp 方法调用外部接口样例

|

||||

|

||||

基于此,我们还希望进一步研究基于这些机制能整出什么花活儿,并能讨论如何进一步利用 LLMs 的能力

|

||||

|

||||

## 回顾:HuggingGPT 对 Decomp 方法的使用

|

||||

### 回顾:HuggingGPT 对 Decomp 方法的使用

|

||||

|

||||

[HuggingGPT](https://arxiv.org/abs/2303.17580) 一文也许并未直接参考 Decomp 方法,而是用一些更规范的手法完成该任务,但其充分流水线化的 Prompt 工程无疑是 Decomp 方法在落地实践上的最佳注脚

|

||||

|

||||

@@ -373,7 +372,7 @@ HuggingGPT

|

||||

|

||||

接下来,我们会讨论一个很新的,在为 Agent 模拟任务构建框架上,把 Decomp 和 Prompting 技术用到登峰造极的样例。

|

||||

|

||||

# Generative Agents:社群模拟实验

|

||||

## Generative Agents:社群模拟实验

|

||||

|

||||

[[2304.03442] Generative Agents: Interactive Simulacra of Human Behavior (](https://arxiv.org/abs/2304.03442)[arxiv.org](https://arxiv.org/abs/2304.03442)[)](https://arxiv.org/abs/2304.03442)

|

||||

|

||||

@@ -383,7 +382,7 @@ Generative Agents 一文通过的自然语言框架 AI 构建出了一个模拟

|

||||

|

||||

因为,其本质是一个信息管理框架的实验。

|

||||

|

||||

## 简要介绍

|

||||

### 简要介绍

|

||||

|

||||

简单介绍该项目构建的框架:

|

||||

|

||||

@@ -399,7 +398,7 @@ Generative Agents 构建了一套框架,让 NPC 可以感知被模块化的世

|

||||

|

||||

根据 NPC 的决策,NPC 能反向更新自身所使用的记忆数据库,并提炼总结出高层记忆供后续使用。

|

||||

|

||||

## 世界沙盒的构建

|

||||

### 世界沙盒的构建

|

||||

|

||||

相比角色信息的构建是重头戏,世界沙盒的构建使用的方法要相对朴素一些

|

||||

|

||||

@@ -419,7 +418,7 @@ Generative Agents 的场景信息管理

|

||||

|

||||

同时,空间信息会被自动组成自然语言 Prompt,用于帮助 Agent 更好地理解外部信息。甚至当 Agent 希望获取空间信息时,其能主动递归调用世界信息,从而让 NPC 能准确找到其希望抵达的叶子节点。

|

||||

|

||||

## Agent 构建

|

||||

### Agent 构建

|

||||

|

||||

模型中的 Agent 由 数据库 + LLMs 构建

|

||||

|

||||

@@ -431,13 +430,13 @@ Generative Agents 的场景信息管理

|

||||

|

||||

而对于过去经验的输入,则是文章的一大亮点

|

||||

|

||||

## 记忆模式

|

||||

### 记忆模式

|

||||

|

||||

对于 Agent 的记忆,依托于一个储存信息流的数据库

|

||||

|

||||

数据库中核心储存三类关键记忆信息 memory, planning and reflection

|

||||

|

||||

### Memory

|

||||

#### Memory

|

||||

|

||||

对于 Agent 每个时间步观测到的事件,会被顺序标记时间戳储存进记忆数据库中

|

||||

|

||||

@@ -449,11 +448,11 @@ Generative Agents 的场景信息管理

|

||||

|

||||

对于对记忆数据库进行索引的情况,会实时评估上述三个指标,并组合权重,返回对记忆索引内容的排序

|

||||

|

||||

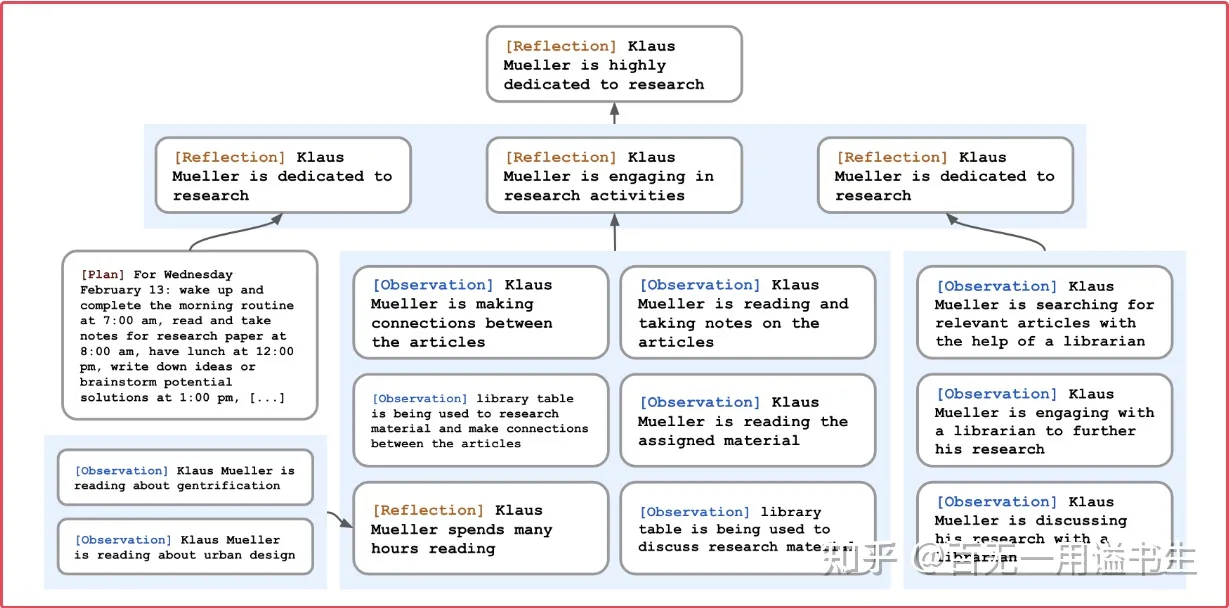

### Reflection

|

||||

#### Reflection

|

||||

|

||||

反思机制用于定期整理当前的 memory 数据库,让 npc 构建对世界和自身的高层认知

|

||||

|

||||

反思机制依靠一个自动的过程,反思-提问-解答

|

||||

反思机制依靠一个自动的过程,反思 - 提问 - 解答

|

||||

|

||||

在这个过程中,Agent 需要复盘自身所接受的记忆,并基于记忆对自己进行追问:

|

||||

|

||||

@@ -465,7 +464,7 @@ Generative Agents 的场景信息管理

|

||||

|

||||

进一步的,我们将这些洞察以相同的形式重新储存至记忆库中,由此模拟人类的记忆认知过程

|

||||

|

||||

### Planning

|

||||

#### Planning

|

||||

|

||||

Planning 的核心在于鼓励 Agent 为未来做出一定的规划,使得后续行动变得可信

|

||||

|

||||

@@ -475,13 +474,13 @@ Planning 的核心在于鼓励 Agent 为未来做出一定的规划,使得后

|

||||

|

||||

在此基础上,Agent 也需要对环境做出反应而调整自己的计划表(例如自身判断外界交互的优先级比当前计划更高。

|

||||

|

||||

## 交互构建

|

||||

### 交互构建

|

||||

|

||||

基于上述记忆框架,进一步实时让 Agent 自行感知并选择与其它 Agent 构建交互

|

||||

|

||||

并最终使得复杂的社群在交互中涌现

|

||||

|

||||

## 启发

|

||||

### 启发

|

||||

|

||||

Generative Agent 框架主要带来了一些启发,不止于 AI-NPC 的构建,其操作的诸多细节都是能进一步为我们在实际的工程中所延拓的。

|

||||

|

||||

@@ -497,7 +496,7 @@ Generative Agent 框架主要带来了一些启发,不止于 AI-NPC 的构建

|

||||

- AI x 信息自动化系统的构建:基于 AI + 软件系统而非基于人工对数据进行收集和管理

|

||||

- etc...

|

||||

|

||||

# AutoGPT:自动化的智能软件系统

|

||||

## AutoGPT:自动化的智能软件系统

|

||||

|

||||

[Torantulino/Auto-GPT: An experimental open-source attempt to make GPT-4 fully autonomous. (](https://github.com/Torantulino/Auto-GPT)[github.com](https://github.com/Torantulino/Auto-GPT)[)](https://github.com/Torantulino/Auto-GPT)[github.com/Torantulino/Auto-GPT](https://github.com/Torantulino/Auto-GPT)

|

||||

|

||||

@@ -530,7 +529,7 @@ AutoGPT 主要特性如下:

|

||||

|

||||

(如下是 AutoGPT 的基础 Prompt)

|

||||

|

||||

```

|

||||

```txt

|

||||

[

|

||||

{

|

||||

'content': 'You are Eliza, an AI designed to write code according to my requirements.\n'

|

||||

@@ -613,7 +612,7 @@ AutoGPT 主要特性如下:

|

||||

]

|

||||

```

|

||||

|

||||

# 回归正题:AI 作为智能系统

|

||||

## 回归正题:AI 作为智能系统

|

||||

|

||||

作为正题的回归,我们需要重新考虑什么是一个 AI,一个能帮助我们的 AI 应当处于什么样的现实形态?

|

||||

|

||||

@@ -625,7 +624,7 @@ AutoGPT 主要特性如下:

|

||||

|

||||

接下来,我们会围绕此进行展开

|

||||

|

||||

## 意识理论之于 AI:全局工作空间理论

|

||||

### 意识理论之于 AI:全局工作空间理论

|

||||

|

||||

全局工作空间理论(英语:Global workspace theory,GWT)是美国心理学家伯纳德·巴尔斯提出的[意识](https://zh.wikipedia.org/wiki/%E6%84%8F%E8%AF%86)模型。该理论假设意识与一个全局的“广播系统”相关联,这个系统会在整个大脑中广播资讯。大脑中专属的智能处理器会按照惯常的方式自动处理资讯,这个时候不会形成[意识](https://zh.wikipedia.org/wiki/%E6%84%8F%E8%AF%86)。当人面对新的或者是与习惯性刺激不同的事物时,各种专属智能处理器会透过合作或竞争的方式,在全局工作空间中对新事物进行分析以获得最佳结果,而意识正是在这个过程中得以产生。

|

||||

|

||||

@@ -649,7 +648,7 @@ AutoGPT 主要特性如下:

|

||||

- 知觉系统(现在)

|

||||

- 运动系统(未来)

|

||||

|

||||

### 例子:意识系统 For Generative Agent

|

||||

#### 例子:意识系统 For Generative Agent

|

||||

|

||||

单独解释的话,或许会比较麻烦,毕竟我对认知科学并不专业

|

||||

|

||||

@@ -671,9 +670,9 @@ AutoGPT 主要特性如下:

|

||||

|

||||

当然,我个人对该问题的认知与 GPT4 并非完全相同,包括注意系统与运动系统的部分。但其实我并不一定需要将所有东西全都呈现出来,因为在框架上它已然如此。

|

||||

|

||||

记忆、评估、反思这几块的设计通过 Prompt 把 LLMs 劣化成专用的智能处理器单元, 并系统性实现信息的整合与输出。从整体的观点上来看,Generative Agents 中的 Agent,其主体性并不在于 LLM,而是在于这个完整的系统。(相应的,LLMs 只是这个系统的运算工具和陈述工具)

|

||||

记忆、评估、反思这几块的设计通过 Prompt 把 LLMs 劣化成专用的智能处理器单元,并系统性实现信息的整合与输出。从整体的观点上来看,Generative Agents 中的 Agent,其主体性并不在于 LLM,而是在于这个完整的系统。(相应的,LLMs 只是这个系统的运算工具和陈述工具)

|

||||

|

||||

### 例子:AutoGPT 的考察

|

||||

#### 例子:AutoGPT 的考察

|

||||

|

||||

我们再从相同的角度考察 AutoGPT 这一项目:

|

||||

|

||||

@@ -690,7 +689,7 @@ AutoGPT 主要特性如下:

|

||||

|

||||

这也对应 AutoGPT 虽然看似有着极强的能力,但实际智能效果又不足为外人道也

|

||||

|

||||

## 构建一个什么样的智能系统

|

||||

### 构建一个什么样的智能系统

|

||||

|

||||

再次回归正题,Generative Agents 和 AutoGPT 这两个知名项目共同将 AI 研究从大模型能力研究导向了智能系统能力研究。而我们也不能驻足不前,我们应当更积极地考虑我们对于一个 AI 智能体有着什么样的需求,也对应我们需要构建、要怎么构建一个基于 LLMs 语言能力的可信可用的智能系统。

|

||||

|

||||

@@ -708,7 +707,7 @@ AutoGPT 主要特性如下:

|

||||

|

||||

这些问题都在指导、质问我们究竟需要一个怎样的智能系统。

|

||||

|

||||

# 予智能以信息:难题与展望

|

||||

## 予智能以信息:难题与展望

|

||||

|

||||

回到最开始的话题,我们构建一个可用智能系统的基底,依旧是信息系统

|

||||

|

||||

@@ -724,7 +723,7 @@ AutoGPT 主要特性如下:

|

||||

|

||||

而接下来,我们希望对其进行逐一评估,讨论他们各自将作用的形式,讨论他们需要做到哪一步,又能做到哪一步。

|

||||

|

||||

## 知觉系统:构建 AI 可读的结构化环境

|

||||

### 知觉系统:构建 AI 可读的结构化环境

|

||||

|

||||

知觉系统负责让智能体实现信息的感知,其中也包括对复杂输入信息的解析

|

||||

|

||||

@@ -752,7 +751,7 @@ AutoGPT 所使用的 Commands 接口中,就有很大一部分接口用于实

|

||||

- args: "file": `"<file>"`

|

||||

- 读取文件并解析文本数据

|

||||

|

||||

这些访问接口由程序集暴露给 GPT ,将知觉系统中实际使用的微观处理器隐藏在了系统框架之下

|

||||

这些访问接口由程序集暴露给 GPT,将知觉系统中实际使用的微观处理器隐藏在了系统框架之下

|

||||

|

||||

AutoGPT 所实际感知的信息为纯文本的格式,得益于以开放性 Web 为基础的网络世界环境,AutoGPT 能较方便地通过搜索(依赖于搜索引擎 API)和解析 html 文件(依赖于软件辅助,GPT 难以自行裁剪 html 中过于冗杂的格式信息),从而有效阅读绝大多数互联网信息。

|

||||

|

||||

@@ -804,7 +803,7 @@ Generative Agents 的知觉设计:关联性难题

|

||||

|

||||

仅就这方面而言,作为一个方向性的倡议,对知觉系统的开发可能分为以下步骤

|

||||

|

||||

### <em>数据处理/管理</em>

|

||||

#### <em>数据处理/管理</em>

|

||||

|

||||

- 对 办公文件/数据 构建通用读取接口

|

||||

- 以同类信息为单位,设计通用的字段(由人设计和管理,AI 能力尚不至此)

|

||||

@@ -828,7 +827,7 @@ Generative Agents 的知觉设计:关联性难题

|

||||

- 如储存进 mongoDB

|

||||

- (设计孪生数据的自动更新机制)

|

||||

|

||||

### <em>知觉系统驱动</em>

|

||||

#### <em>知觉系统驱动</em>

|

||||

|

||||

- 基于上述索引数据库,以视图为单位进行访问,并设计 视图 2 Prompt 的转化格式

|

||||

|

||||

@@ -847,7 +846,7 @@ Generative Agents 的知觉设计:关联性难题

|

||||

|

||||

- 对于 Agent 开启的指定任务线程(区分于主线程的感知模块),其起始 Prompt 可能呈这样的形式

|

||||

|

||||

> <br/>如上是你的目标,为了实现这个目标,你可能需要获取一系列的信息,为了帮助你获得信息,我会为你提供一系列的索引访问接口,请你通过如下格式输出语句让我为你返回信息。<br/>注:如果你请求错误,请你阅读返回的报错信息以自我纠正<br/>例:<br/>< 通过接口名称检索("接口名称")><br/>< 通过接口功能检索("访问网页")><br/>< 通过父级名称检索("父级名称")>

|

||||

> <br/>如上是你的目标,为了实现这个目标,你可能需要获取一系列的信息,为了帮助你获得信息,我会为你提供一系列的索引访问接口,请你通过如下格式输出语句让我为你返回信息。<br/>注:如果你请求错误,请你阅读返回的报错信息以自我纠正<br/>例:<br/>< 通过接口名称检索 ("接口名称")><br/>< 通过接口功能检索 ("访问网页")><br/>< 通过父级名称检索 ("父级名称")>

|

||||

|

||||

- 为 GPT 设计自动化指令解析与执行模块

|

||||

|

||||

@@ -861,7 +860,7 @@ Generative Agents 的知觉设计:关联性难题

|

||||

|

||||

> TBD:号被 OpenAI 噶了,我也很绝望啊

|

||||

|

||||

## 工作记忆:组织 AI 记忆系统

|

||||

### 工作记忆:组织 AI 记忆系统

|

||||

|

||||

记忆系统的构成其实相较知觉系统等更为抽象,它用于管理 AI 运行时作为背景的长期记忆,以及定义决定了 AI 当前任务及目标的短期记忆。

|

||||

|

||||

@@ -869,9 +868,9 @@ Generative Agents 的知觉设计:关联性难题

|

||||

|

||||

但我们依旧能从前人的工作中获得一定的参考。

|

||||

|

||||

### AutoGPT 的记忆设计:粗放但有效

|

||||

#### AutoGPT 的记忆设计:粗放但有效

|

||||

|

||||

在 长时记忆(过去)、评估系统(价值)、注意系统(关注) 这三个要素中,AutoGPT 做得比较好的无疑只有第一个。

|

||||

在 长时记忆(过去)、评估系统(价值)、注意系统(关注)这三个要素中,AutoGPT 做得比较好的无疑只有第一个。

|

||||

|

||||

AutoGPT 的核心记忆设计依赖于预包装的 Prompt 本体,这一包装包含如下部分:

|

||||

|

||||

@@ -899,7 +898,7 @@ AutoGPT 的核心记忆设计依赖于预包装的 Prompt 本体,这一包装

|

||||

|

||||

但从另一角度,其“自主将收集到的信息写入记忆”这一功能作为一个 以完成任务为目标 的 Agent 而言无疑是非常合适的架构设计。

|

||||

|

||||

### Generative Agents 的记忆设计:精心构建的金字塔

|

||||

#### Generative Agents 的记忆设计:精心构建的金字塔

|

||||

|

||||

区别于 AutoGPT 主动写入的记忆,Generative Agents 的记忆源自被动的无限感知和记录,因此显得更加没有目的性。也正因如此,其需要一种更妥善的管理形式。

|

||||

|

||||

@@ -907,7 +906,7 @@ Generative Agent 通过自动化评估记忆的价值,并构建遗忘系统、

|

||||

|

||||

|

||||

|

||||

Generative Agents :基于 Reflection 构建记忆金字塔

|

||||

Generative Agents:基于 Reflection 构建记忆金字塔

|

||||

|

||||

进一步的,其通过反思机制强化了记忆的价值,使得高层洞察从既有记忆的连结中涌现,这一机制通常被用于将 信息转化为知识,并构建出了有效记忆的金字塔。

|

||||

|

||||

@@ -915,7 +914,7 @@ Generative Agents :基于 Reflection 构建记忆金字塔

|

||||

|

||||

相关的更有效的记忆管理无疑很快就会被更新的项目学习。

|

||||

|

||||

### 记忆系统的构建讨论(放飞大脑)

|

||||

#### 记忆系统的构建讨论(放飞大脑)

|

||||

|

||||

但从某种意义上来说,对于一个我们希望其帮助我们工作的智能体而言,像 Generative Agent 这般的巨大数据库也许并未有充分的价值,何况我们所输入的内容原始层级就较高(这一层可能在前面的知觉系统中,就让一定程度上的高层洞见自主产生了),不易于进一步的堆叠。

|

||||

|

||||

@@ -933,7 +932,7 @@ Generative Agents :基于 Reflection 构建记忆金字塔

|

||||

|

||||

(可以遇见的,以 AutoGPT 的热度,半个月内就会有人为其设计相应的 mod)

|

||||

|

||||

## 运动系统:让 AI 可及一切

|

||||

### 运动系统:让 AI 可及一切

|

||||

|

||||

基于知觉系统和记忆系统,已经能构建一个使用语言解决问题的智能体了。但最为关键的改造世界部分则依旧缺席。

|

||||

|

||||

@@ -943,7 +942,7 @@ Generative Agents :基于 Reflection 构建记忆金字塔

|

||||

|

||||

- 我们大胆假设未来游戏中的 Agent 能通过 API 驱动自身在场景中无拘无束(拼装行为树

|

||||

- 再大胆假设他们能使用 API 实时把需求的内容转化为发布给玩家的任务(拼装任务节点

|

||||

- 继续大胆假设, AI 根据我的需求把今天要配的啥比表直接配完,当场下班(笑

|

||||

- 继续大胆假设,AI 根据我的需求把今天要配的啥比表直接配完,当场下班(笑

|

||||

|

||||

(而这一切,都是可能,且近在眼前的)

|

||||

|

||||

@@ -963,7 +962,7 @@ AI 能做的一切都基于我们的赋予,包括语言能力,包括思维

|

||||

- 我们不该将其当作独立的智能体看待,但能在其基础上通过构建系统创建智能 Agent

|

||||

- 为此,我们需要通过信息工程,让 AI 能够真正感知和改造世界,从而改变我们的生产进程

|

||||

|

||||

# 寄予厚望

|

||||

## 寄予厚望

|

||||

|

||||

感谢有人忍受了我阴间的行文和一路跑偏的思路,真能看到这里

|

||||

|

||||

|

||||

Reference in New Issue

Block a user